Source: The Conversation – France in French (3) – By Taha Yasseri, Workday Professor of Technology and Society, Trinity College Dublin

Grokipedia, le nouveau projet d’Elon Musk, mis en ligne le 27 octobre 2025, promet plus de neutralité que Wikipédia. Pourtant, les modèles d’IA sur lesquels il repose restent marqués par les biais de leurs données.

La société d’intelligence artificielle d’Elon Musk, xAI, a lancé, le 27 octobre 2025, la version bêta d’un nouveau projet destiné à concurrencer Wikipédia, Grokipedia. Musk présente ce dernier comme une alternative à ce qu’il considère être « le biais politique et idéologique » de Wikipédia. L’entrepreneur promet que sa plateforme fournira des informations plus précises et mieux contextualisées grâce à Grok, le chatbot de xAI, qui générera et vérifiera le contenu.

A-t-il raison ? La problématique du biais de Wikipédia fait débat depuis sa création en 2001. Les contenus de Wikipédia sont rédigés et mis à jour par des bénévoles qui ne peuvent citer que des sources déjà publiées, puisque la plateforme interdit toute recherche originale. Cette règle, censée garantir la vérifiabilité des faits, implique que la couverture de Wikipédia reflète inévitablement les biais des médias, du monde académique et des autres institutions dont elle dépend.

Ces biais ne sont pas uniquement politiques. Ainsi, de nombreuses recherches ont montré un fort déséquilibre entre les genres parmi les contributeurs, dont environ 80 % à 90 % s’identifient comme des hommes dans la version anglophone. Comme la plupart des sources secondaires sont elles aussi majoritairement produites par des hommes, Wikipédia tend à refléter une vision plus étroite du monde : un dépôt du savoir masculin plutôt qu’un véritable panorama équilibré des connaissances humaines.

Le problème du bénévolat

Sur les plateformes collaboratives, les biais tiennent souvent moins aux règles qu’à la composition de la communauté. La participation volontaire introduit ce que les sciences sociales appellent un « biais d’autosélection » : les personnes qui choisissent de contribuer partagent souvent des motivations, des valeurs et parfois des orientations politiques similaires.

De la même manière que Wikipédia dépend de cette participation volontaire, c’est aussi le cas de Community Notes, l’outil de vérification des faits de Musk sur X (anciennement Twitter). Une analyse que j’ai menée avec des collègues montre que sa source externe la plus citée, après X lui-même, est en réalité Wikipédia.

Les autres sources les plus utilisées se concentrent elles aussi du côté des médias centristes ou orientés à gauche. Elles reprennent la même liste de sources « approuvées » que Wikipédia ; c’est-à-dire précisément le cœur des critiques de Musk adressées à l’encyclopédie ouverte en ligne. Pourtant, personne ne reproche ce biais à Musk.

Tada Images

Wikipédia reste au moins l’une des rares grandes plateformes à reconnaître ouvertement ses limites et à les documenter. La recherche de la neutralité y est inscrite comme l’un de ses cinq principes fondateurs. Des biais existent, certes, mais l’infrastructure est conçue pour les rendre visibles et corrigibles.

Les articles contiennent souvent plusieurs points de vue, traitent des controverses et même consacrent des sections entières aux théories complotistes, comme celles entourant les attentats du 11-Septembre. Les désaccords apparaissent dans l’historique des modifications et sur les pages de discussion, et les affirmations contestées sont signalées. La plateforme est imparfaite mais autorégulée, fondée sur le pluralisme et le débat ouvert.

L’IA est-elle impartiale ?

Si Wikipédia reflète les biais de ses contributeurs humains et des sources qu’ils mobilisent, l’IA souffre du même problème avec ses données d’entraînement. Grokipedia : Elon Musk a raison de dire que Wikipédia est biaisée, mais son alternative fondée sur l’IA ne fera pas mieux

Les grands modèles de langage (LLM) utilisés par Grok sont formés sur d’immenses corpus issus d’Internet, comme les réseaux sociaux, les livres, les articles de presse et Wikipédia elle-même. Des études ont montré que ces modèles reproduisent les biais existants – qu’ils soient de genre, d’ordre politique ou racial – présents dans leurs données d’entraînement.

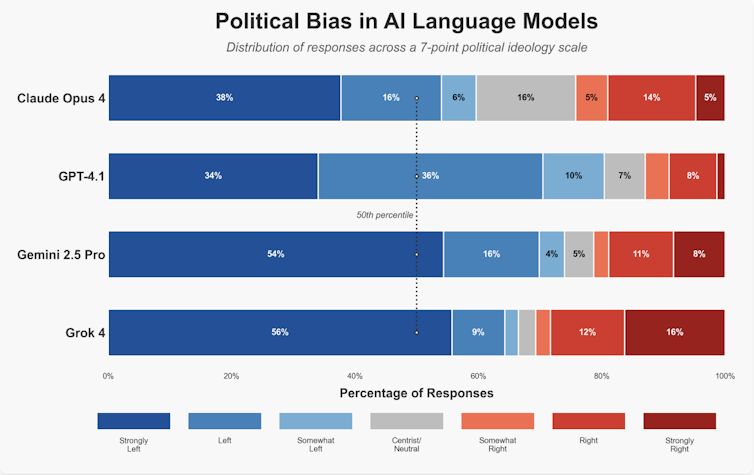

Musk affirme que Grok a été conçu pour contrer de telles distorsions, mais Grok lui-même a été accusé de partialité. Un test, dans laquelle quatre grands modèles de langage ont été soumis à 2 500 questions politiques, semble montrer que Grok est plus neutre politiquement que ses rivaux, mais présente malgré tout un biais légèrement orienté à gauche (les autres étant davantage marqués à gauche).

Michael D’Angelo/Promptfoo, CC BY-SA

Si le modèle qui soustend Grokipedia repose sur les mêmes données et algorithmes, il est difficile d’imaginer comment une encyclopédie pilotée par l’IA pourrait éviter de reproduire les biais que Musk reproche à Wikipédia. Plus grave encore, les LLM pourraient accentuer le problème. Ceux-ci fonctionnent de manière probabiliste, en prédisant le mot ou l’expression la plus probable à venir sur la base de régularités statistiques, et non par une délibération entre humains. Le résultat est ce que les chercheurs appellent une « illusion de consensus » : une réponse qui sonne de manière autoritaire, mais qui masque l’incertitude ou la diversité des opinions.

De ce fait, les LLM tendent à homogénéiser la diversité politique et à privilégier les points de vue majoritaires au détriment des minoritaires. Ces systèmes risquent ainsi de transformer le savoir collectif en un récit lisse mais superficiel. Quand le biais se cache sous une prose fluide, les lecteurs peuvent même ne plus percevoir que d’autres perspectives existent.

Ne pas jeter le bébé avec l’eau du bain

Cela dit, l’IA peut aussi renforcer un projet comme Wikipédia. Des outils d’IA contribuent déjà à détecter le vandalisme, à suggérer des sources ou à identifier des incohérences dans les articles. Des recherches récentes montrent que l’automatisation peut améliorer la précision si elle est utilisée de manière transparente et sous supervision humaine.

L’IA pourrait aussi faciliter le transfert de connaissances entre différentes éditions linguistiques et rapprocher la communauté des contributeurs. Bien mise en œuvre, elle pourrait rendre Wikipédia plus inclusif, efficace et réactif sans renier son éthique centrée sur l’humain.

De la même manière que Wikipédia peut s’inspirer de l’IA, la plate-forme X pourrait tirer des enseignements du modèle de construction de consensus de Wikipédia. Community Notes permet aux utilisateurs de proposer et d’évaluer des annotations sur des publications, mais sa conception limite les discussions directes entre contributeurs.

Un autre projet de recherche auquel j’ai participé a montré que les systèmes fondés sur la délibération, inspirés des pages de discussion de Wikipédia, améliorent la précision et la confiance entre participants, y compris lorsque cette délibération implique à la fois des humains et une IA. Favoriser le dialogue plutôt que le simple vote pour ou contre rendrait Community Notes plus transparent, pluraliste et résistant à la polarisation politique.

Profit et motivation

Une différence plus profonde entre Wikipédia et Grokipedia tient à leur finalité et, sans doute, à leur modèle économique. Wikipédia est géré par la fondation à but non lucratif Wikimedia Foundation, et la majorité de ses bénévoles sont motivés avant tout par l’intérêt général. À l’inverse, xAI, X et Grokipedia sont des entreprises commerciales.

Même si la recherche du profit n’est pas en soi immorale, elle peut fausser les incitations. Lorsque X a commencé à vendre sa vérification par coche bleue, la crédibilité est devenue une marchandise plutôt qu’un gage de confiance. Si le savoir est monétisé de manière similaire, le biais pourrait s’accentuer, façonné par ce qui génère le plus d’engagements et de revenus.

Le véritable progrès ne réside pas dans l’abandon de la collaboration humaine mais dans son amélioration. Ceux qui perçoivent des biais dans Wikipédia, y compris Musk lui-même, pourraient contribuer davantage en encourageant la participation d’éditeurs issus d’horizons politiques, culturels et démographiques variés – ou en rejoignant eux-mêmes l’effort collectif pour améliorer les articles existants. À une époque de plus en plus marquée par la désinformation, la transparence, la diversité et le débat ouvert restent nos meilleurs outils pour nous approcher de la vérité.

![]()

Taha Yasseri a reçu des financements de Research Ireland et de Workday.

– ref. Elon Musk a raison de dire que Wikipédia est biaisé, mais Grokipedia et l’IA ne feront pas mieux – https://theconversation.com/elon-musk-a-raison-de-dire-que-wikipedia-est-biaise-mais-grokipedia-et-lia-ne-feront-pas-mieux-267845