Source: The Conversation – in French – By Grégory Miras, Professeur des Universités en didactique des langues, Université de Lorraine

Former les élèves aux usages de l’IA est présenté comme une priorité politique pour les années à venir. Mais comment intégrer les préparations nécessaires aux cursus scolaires sans alourdir les coûts écologiques ? Il faut aussi compter avec un certain nombre d’enjeux éthiques.

L’année scolaire 2025-2026 s’ouvre dans un contexte de démocratisation massive de l’intelligence artificielle (IA) générative. Dans son dossier de rentrée, le ministère de l’éducation précise d’ailleurs que les élèves du second degré bénéficieront désormais d’un parcours de formation spécifique, sur la plateforme PIX. Faut-il voir dans ces nouveaux outils une menace à l’apprentissage et la maîtrise des langues, le français et celles dites étrangères ?

À l’heure où l’IA-anxiété devient un phénomène social, voici quelques éléments de réflexion pour les plus inquiets mais aussi les plus convaincus.

Converser avec l’IA : coût écologique et éthique

Si l’IA générative séduit par sa capacité à produire du texte ou à traduire instantanément, elle comporte des coûts cachés. S’entraîner à formuler des requêtes (prompt en anglais) amène à une interaction langagière qui mobilise d’immenses ressources humaines, matérielles et énergétiques, souvent invisibles à l’utilisateur. La Direction de région académique du numérique pour l’éducation de l’académie de Versailles rappelle aux enseignants que :

-

une requête d’environ 400 tokens sur ChatGPT/GPT-4o mini consomme environ 2 Wh d’électricité (ou 2 g de CO2 rejeté), soit plus de 6 fois la consommation d’une recherche Google classique estimée à 0,3 Wh ;

-

la création d’une image en haute définition par une IA consomme autant d’énergie que la recharge complète d’un téléphone portable ;

-

les centres de données (data centers) liés à l’IA et aux cryptomonnaies ont consommé près de 460 TWh d’électricité en 2022, soit environ 2 % de la production mondiale.

S’exercer à développer un esprit critique face à l’IA devient incontournable. Cependant, amener les élèves à utiliser massivement les IA pour mieux les comprendre provoque un paradoxe. Une piste consiste alors à privilégier des IA éducatives dites « responsables », à l’image du modèle Vittascience, qui assure la transparence de ses données d’entraînement et de son fonctionnement. Entraînés à partir d’une quantité limitée de données, ces modèles apparaissent comme moins énergivores.

Il est également possible de proposer des ateliers, par exemple des escapes games, qui mobilisent des éléments pratiques pour aborder les principaux points en jeu sans nécessairement s’exercer sur des outils numériques.

D’un point de vue éthique, les grands modèles de langage (LLM) sont entraînés sur des corpus massifs constitués de textes issus de contenus en ligne. Cette alimentation soulève des questions majeures, en particulier autour de la propriété et de l’usage des données linguistiques.

Qui possède les mots, les expressions, les récits mis à disposition sur Internet ? Dans quelle mesure la réutilisation de ces ressources respecte-t-elle le droit d’auteur, la rémunération des créateurs ou encore la diversité linguistique et culturelle ?

Une machine à (re)produire des inégalités langagières ?

Enseignants comme parents accusent volontiers l’IA d’aider à tricher lors de devoirs écrits, creusant ainsi les inégalités scolaires et langagières. Pourtant, celles-ci préexistaient largement à son arrivée. Les élèves ne bénéficient pas tous des mêmes soutiens selon leur environnement familial. Certains peuvent compter sur des parents disposant d’un capital social et culturel élevé, capables de relire un devoir, de le corriger ou de l’enrichir.

L’arrivée des LLM a pu apparaître, dans le mandat de l’Unesco, comme une forme de démocratisation : « La promesse de « l’IA pour tous » doit permettre à chacun de bénéficier de la révolution technologique en cours et d’accéder à ses fruits, notamment en termes d’innovation et de connaissances. » Cette « IA pour tous » offrirait à chaque apprenant des outils disponibles en permanence (correcteur virtuel, un traducteur instantané, etc.), pouvant s’adapter à des besoins particuliers (élèves allophones, troubles du spectre autistique, un TDAH).

Cependant, les outils d’IA peuvent introduire de nouvelles inégalités, plus fallacieuses, comme le souligne Jeremy Knox, professeur à l’Université d’Oxford. En effet, cette amplification dépend à la fois de l’accès effectif aux technologies (déjà issu des inégalités sociales), des compétences nécessaires pour en tirer parti (littéracie numérique) et de la qualité des données qui les alimentent.

Dans une étude récente, des chercheurs en sociologie de l’information à l’Université de Stanford montrent que les auteurs de textes scientifiques en anglais, dont ce n’est pas la langue première, sont défavorisés dans l’évaluation scientifique, leur style d’écriture étant jugé de moindre qualité. L’arrivée de ChatGPT réduit légèrement ces biais en améliorant la traduction tout en contribuant à déplacer ces inégalités, non plus sur la maîtrise de l’anglais, mais sur l’hypothèse d’un usage de l’IA dans la production de ces textes. On imagine aisément un tel phénomène dans les évaluations scolaires.

L’humain derrière la machine parlante

Ces cinq dernières années, on assiste à une multiplication de guides éducatifs d’utilisation de l’IA tout autant qu’à une explosion des appels à financements éducatifs et de recherche autour de ces technologies. Ils permettent de financer des projets d’envergure comme le cluster IA-Enact porté par l’Université de Lorraine.

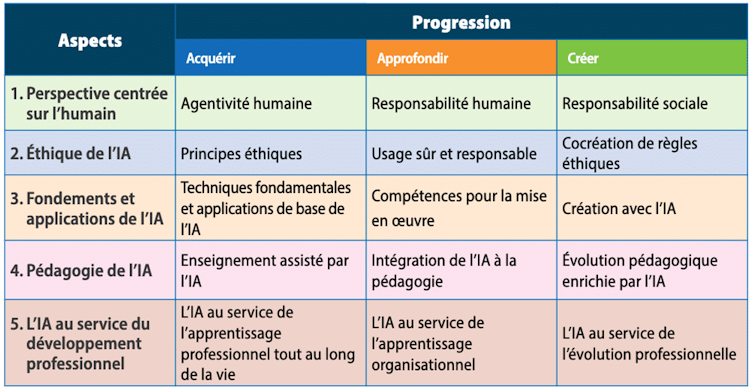

Toutefois, la multiplication de ces financements suscite des inquiétudes légitimes quant à l’ampleur des sommes investies au détriment d’autres sources de financement destinées à soutenir une vision alternative de la société. Aussi, il parait nécessaire de rappeler que certains cadres autour de l’IA soulignent l’importance de (re)penser une perspective centrée sur l’humain avant de réfléchir à la technologie en elle-même, comme le propose le Cadre de compétence en IA destiné aux enseignants par l’Unesco.

Dans ce contexte, l’école a un rôle central à jouer en sensibilisant les élèves à l’IA tout en développant leurs compétences en littéracies numériques et informationnelles. Mais, l’enseignement de la langue ne se limite pas à la transmission d’un code linguistique conforme aux normes grammaticales et syntaxiques, il s’agit avant tout d’enseigner la langue comme vecteur d’identité, comme manière de penser le monde et comme moyen privilégié de rencontre avec l’autre.

Penser l’école, et par extension une société avec ou sans l’IA, implique ainsi une réflexion autour du modèle social en construction. L’enseignante-chercheuse Karën Fort, lors d’une conférence en linguistique appliquée organisée par l’Association française de linguistique appliquée, soutient la nécessité de développer et diffuser des IA libres et plus ciblées aux différents usages en opposition aux modèles libéraux et capitalistes de la Silicon Valley. L’école ne devrait-elle pas principalement considérer l’IA comme un outil parmi d’autres pour soutenir les valeurs humaines indispensables au développement de futurs citoyens ?

![]()

Les auteurs ne travaillent pas, ne conseillent pas, ne possèdent pas de parts, ne reçoivent pas de fonds d’une organisation qui pourrait tirer profit de cet article, et n’ont déclaré aucune autre affiliation que leur organisme de recherche.

– ref. IA et langues : de nouvelles pratiques à l’école, à quel prix ? – https://theconversation.com/ia-et-langues-de-nouvelles-pratiques-a-lecole-a-quel-prix-263840