Source: The Conversation – (in Spanish) – By Filiberto Pla Bañón, Profesor de Lenguajes y Sistemas Informáticos, Universitat Jaume I

La respuesta corta es que sí, y mucho mejor. La respuesta larga requeriría abundar en qué consideramos “ver”, que va más allá de un mero acto mecánico para ser un proceso cognitivo complejo que atribuimos netamente a los seres humanos.

Aun así, lo cierto es que nuestra visión, comparada con la de otros seres vivos, es bastante regular o mala. Aunque podemos percibir el color de una forma aceptable, poseemos una agudeza visual bastante mediocre a larga distancia, con una capacidad de distinción del detalle muy limitada.

Hay infinidad de ejemplos en otras especies que han desarrollado órganos visuales (y perceptivos en general) muchísimo mejores que los nuestros. Siendo así, hemos desarrollado estrategias tecnológicas que nos permiten trascender nuestras limitadas capacidades biológicas de “fábrica”.

Máquinas “tontas” que ven mejor que nosotros

Resulta que las máquinas que creamos para extender nuestra visión más allá de nuestros límites “ven” muchísimo mejor que nosotros. Y eso a pesar de que nos empeñamos en considerar que siguen siendo máquinas “tontas”, pues carecen de esa capacidad humana del “ver”, esto es, “entender”.

Tenemos ejemplos muy recientes de cómo la tecnología de imagen ha avanzado en aquello que el filósofo alemán Martin Heidegger llamaba “la época de la imagen del mundo”, en su ensayo del mismo título The Era of the World Picture.

Desgraciadamente, esta visión extendida que nos permite ver todos los rincones del planeta como nunca antes había sido posible también sirve, por ejemplo, a labores militares de vigilancia, monitorización por satélite y ataque de “objetivos enemigos”. Un ejemplo son los recientes acontecimientos bélicos en Irán, con el uso de drones FPV (First Person View, de control remoto en primera persona).

Somos fáciles de engañar

Al mismo tiempo, la inteligencia artificial generativa avanza a zancadas, produciendo imágenes realistas y sofisticadas que nos cuesta diferenciar de la realidad. Podemos ponernos a prueba con tests como el creado por Microsoft con el fin de determinar nuestra capacidad del “ver” qué personas realmente corresponden a gente real y cuáles han sido generadas por IA. O podemos probar con un experimento diseñado para servir de entrenamiento de detección de deepfakes a futuros alumnos de Radiología.

La evidencia empírica confirma que la capacidad humana para diferenciar qué imágenes son falsas está en torno al 62 %. Pero la tasa de aciertos es muy inferior cuando se trata de manipulaciones sofisticadas: la capacidad de detección de deepfakes –imágenes elaboradas con herramientas IA, que son además muy baratas y accesibles– se sitúa por debajo del 25 %. Se calcula que, en 2025, con este tipo de fraude, las organizaciones criminales internacionales han “facturado” más de 10 000 millones de dólares.

Pero no solo es posible generar imágenes con IA con mucha más rapidez y eficacia de lo que lo hacemos nosotros (aunque no sean necesariamente “mejores”): los propios algoritmos de inteligencia artificial también son expertos en detectar las imágenes que han sido manipuladas o directamente generadas por la propia IA o por nosotros mismos de forma manual.

Proyecto SCIMFAKE: Filiberto Pla Bañon y Francisco López Cantos.

Falsificaciones en ciencia

En el ámbito de las publicaciones científicas, han proliferado los escándalos de investigadores que falsifican sus resultados manipulando imágenes. Aunque son detectados en plataformas colaborativas como PubPeer y RetractionWatch, esta mala praxis es muy frecuente. Cada vez es más fácil falsificar imágenes con software convencional, algo difícil de detectar. En este sentido, las nuevas herramientas de IA no hacen más que incrementar la magnitud el problema y acelerar su extensión.

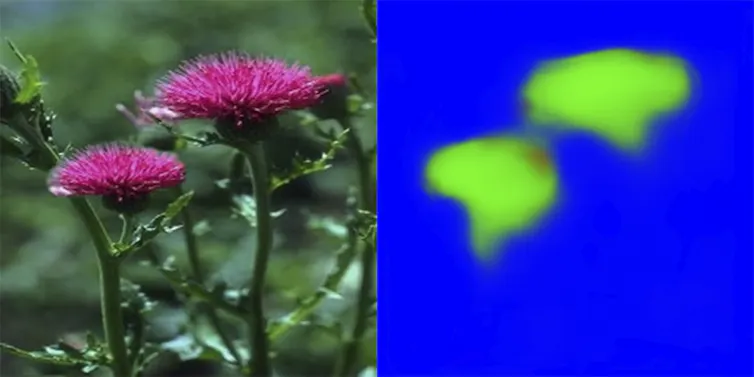

En nuestro proyecto de investigación, nos hemos centrado en la detección de manipulaciones tipo “copy-move” –“copia y mueve”, una técnica de falsificación de imágenes digitales donde una parte de la imagen es copiada y pegada en otra zona de la misma imagen–. El principal objetivo es aplicar nuestras soluciones en el ámbito de la investigación.

Para ello, hemos desarrollado una arquitectura de Red Neuronal Convolucional (CNN) combinada con la utilización de redes basadas en Visual Transformers (ViT). Hemos probado y optimizado su efectividad en sucesivas mejoras sobre bases de datos de referencia, como CASIA y COMOFOD, empleados por grupos de investigación de todo el mundo para ensayar las más vanguardistas técnicas de detección.

Lo que “ve” nuestro sistema de IA es el resultado de un proceso de aprendizaje automatizado en el que, tras dividir el dataset –conjuntos de datos de entrenamiento– en tres subconjuntos de imágenes (entrenamiento, validación y test), se van obteniendo mayores tasas de aciertos. Es un proceso de aprendizaje iterativo que permite mejorar las métricas. Finalmente, la red neuronal queda entrenada para que, cuando se le proporcione una nueva imagen, ya haya aprendido lo suficientemente para detectar si contiene algún elemento que se ha clonado.

Cuando llega una nueva imagen, se realiza primero un procesamiento previo orientado a su optimización y adecuación, y luego se pasa a los procesos más críticos: el reconocimiento de patrones y su identificación.

Para el reconocimiento de patrones, se necesita un proceso de segmentación de la imagen que implica dividirla en sus partes constituyentes. Esto se puede realizar mediante la técnica clásica más sencilla de umbralización (separando objetos según su brillo) o mediante la detección de bordes. Posteriormente, en la fase de descripción, se extraen datos cuantitativos y características de tales objetos, como el área, el perímetro o la textura, como paso previo para su posterior interpretación de forma automatizada.

Finalmente, el sistema asigna una etiqueta al objeto mediante un proceso de clasificación o reconocimiento automático –es decir, si es un vehículo, un caballo, un televisor, etc.–, a partir de una base de conocimiento previo. De esa manera el sistema compara las descripciones extraídas de la imagen con una base de datos de patrones conocidos utilizados en el proceso de aprendizaje automático, y les asigna la etiqueta correspondiente.

Los datos preliminares de nuestros experimentos en el proyecto SCIMFAKE nos permiten detectar la falsificación con unas métricas de precisión en torno al 95 %, muy por encima de lo que se puede lograr a simple vista humana. Estos resultados están en línea con los de otros trabajos de vanguardia, especialmente los desarrollados por grupos de investigación asiáticos.

Así que, en definitiva, y respondiendo a la pregunta inicial, las máquinas “ven” mejor que nosotros. Muchísimo mejor. Ojalá fuera para bien, aunque desgraciadamente también para mal. Por eso, nos guste o no, la investigación y aplicación de las técnicas más vanguardistas de visión artificial hoy son imprescindibles.

![]()

Las personas firmantes no son asalariadas, ni consultoras, ni poseen acciones, ni reciben financiación de ninguna compañía u organización que pueda obtener beneficio de este artículo, y han declarado carecer de vínculos relevantes más allá del cargo académico citado anteriormente.

– ref. ¿Ven las máquinas mejor que nosotros si una imagen es falsa? – https://theconversation.com/ven-las-maquinas-mejor-que-nosotros-si-una-imagen-es-falsa-279251