Source: The Conversation – in French – By Speranta Dumitru, Maitre de Conférences, Université Paris Cité

Le passeport à l’effigie de Donald Trump génère des protestations. Leur intensité est, toutefois, moindre que la colère suscitée, après 1918, par le maintien du passeport lui-même, qui avait été rendu obligatoire durant la Première Guerre mondiale. Des deux côtés de l’Atlantique, la presse en réclamait la suppression, le jugeant coûteux, vexatoire et liberticide. Un siècle plus tard, la contrainte du passeport est normalisée.

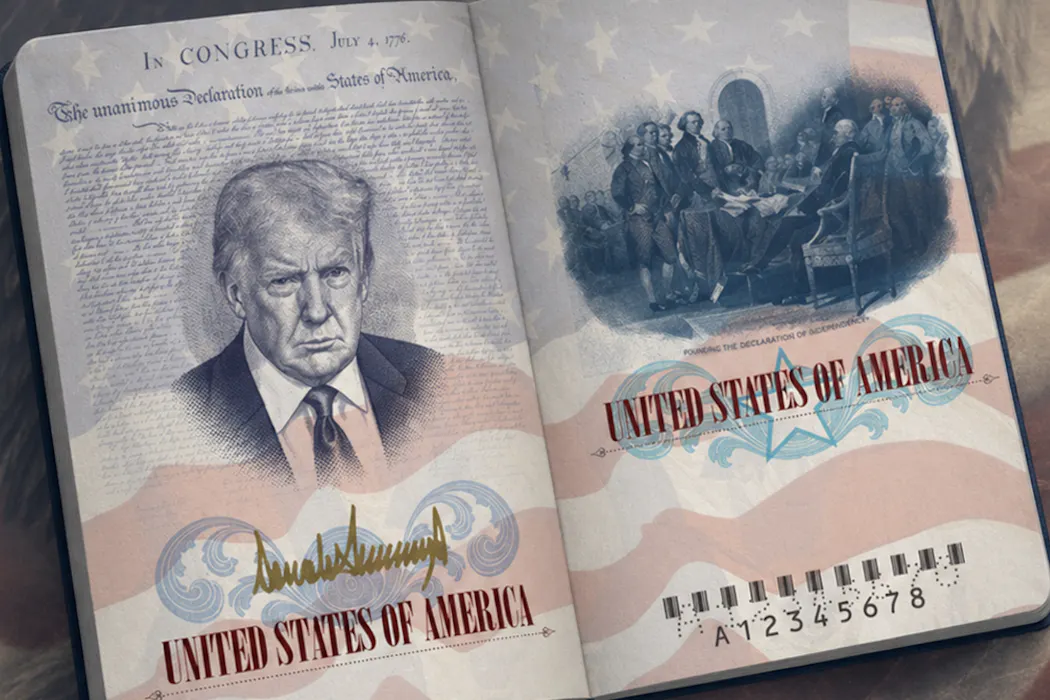

La Maison-Blanche a récemment annoncé qu’une édition limitée de passeports états-uniens à l’effigie du président serait fabriquée dans le cadre des célébrations du 250e anniversaire des États-Unis. Ces passeports, qui comporteront une image de Donald Trump accompagnée de sa signature à l’encre dorée, et dont le nombre exact n’a pas été rendu public, ne seront disponibles que pour les citoyens qui en feront la demande dans la ville de Washington.

Cette décision a immédiatement suscité de vives critiques : certains adversaires y voient une manifestation de culte de la personnalité qu’aucun autocrate n’avait jamais osée.

Le « passeport Trump » est-il « gênant » ? Le verbe « gêner » a deux significations : embarrasser, et limiter la liberté. Les détracteurs de cette initiative se sentent gênés surtout dans le premier sens : ils ont honte de voir leur président profiter de l’anniversaire de l’indépendance du pays pour se mettre en avant. Mais la seconde signification, celle liée à la restriction de la liberté de circulation, est bien plus durable : depuis plus d’un siècle, devoir obtenir un passeport pour pouvoir voyager gêne considérablement les gens, partout dans le monde.

Le régime des passeports obligatoires

Nos arrière-grands-parents ont affublé le passeport de tous les noms : une « gêne », une « vexation », une « nuisance ». Le régime des passeports obligatoires, tel qu’on le connaît aujourd’hui, avait été introduit durant la Première Guerre mondiale. Les pays belligérants, tels que la France ou le Royaume-Uni, l’instaurent dès le début des hostilités, en août 1914. Initialement, la justification est de pouvoir contrôler les ressortissants des puissances ennemies. Mais pour contrôler efficacement les étrangers, il est nécessaire de surveiller l’ensemble de la population.

C’est ainsi que l’obligation des passeports s’avère doublement contagieuse : non seulement elle s’étend, dans les pays belligérants, des étrangers aux citoyens, mais elle se diffuse aussi des pays belligérants vers les pays neutres. Pour permettre à leurs citoyens de voyager, tous les pays se voient contraints d’organiser la délivrance des passeports. Prenons l’exemple des États-Unis. Dès le 1er août 1914, le Département d’État demande à ses ambassades en Europe de délivrer des documents aux citoyens états-uniens qui s’y trouvent sans passeport. Alors que dès 1916 les compagnies de transport refusent d’embarquer des passagers ne disposant pas de passeport, le premier fondement légal pour contrôler l’entrée et la sortie des citoyens et des étrangers aux États-Unis n’apparaît qu’en 1918, un peu avant la fin de la guerre.

Personne n’imagine que l’obligation du passeport perdure après la fin du conflit mondial. Au moment de l’armistice, on espère revenir au régime de circulation d’avant-guerre. La Société des Nations (ancêtre de l’ONU) cherche à répondre — sans succès — à la demande de suppression ou d’abolition des passeports. Comme certains gouvernements temporisent, la Société des Nations propose la simplification du passage des frontières, en demandant aux pays d’adopter un modèle uniforme de passeport — celui que nous connaissons aujourd’hui.

Tout passeport est une « gêne »

Dès 1918, la presse se fait l’écho de l’impatience du public. En France, des centaines de journaux mentionnent l’abolition des passeports : ils l’annoncent prochaine… durant toute la période de l’entre-deux-guerres.

Quelques titres d’articles illustrent la persistance de cette attente, bien qu’elle diminue vers la fin des années 1930 : « À bas l’odieux passeport » (L’Humanité, 21 décembre 1921) ; « L’absurde formalité » (Le Figaro, 19 mai 1923) ; « Supprimons les passeports » (La Volonté, 17 janvier 1928) ; « Le passeport est une gêne pour les honnêtes gens » (Le Quotidien, 3 octobre 1929) ; « La mort du passeport » (Le Soir, 14 avril 1931) ; « Il faut qu’on supprime les passeports » (La Gazette de Biarritz-Bayonne et Saint-Jean-de-Luz, 11 juillet 1933).

On pourrait penser que la bataille est menée par les journaux de gauche. Dans ma recherche, j’ai analysé plus de 700 articles qui mentionnent l’abolition des passeports dans la presse française de l’entre-deux-guerres. Ma conclusion est que la majorité des abolitionnistes ne sont pas de gauche, mais de droite et de centre droit. Au Figaro, par exemple, le passeport est vu comme « l’exigence administrative la plus insupportable pour les Français » car « on ne saurait croire quelles démarches, quels ennuis, quelles tracasseries » fait subir aux « honnêtes gens » « toute cette paperasserie » (15 juillet 1921).

Même le journal d’extrême droite L’Action Française ne sabote pas cette « unanimité » et reconnaît que le passeport est une « véritable brimade pour le voyageur ». Pesant « le pour et le contre » de la suppression, il rappelle le 7 septembre 1921 que :

« Dans les États bien organisés, le passeport est une sérieuse garantie contre les espions. Un gouvernement fort et clairvoyant, une bonne police, peuvent s’en faire une arme solide. C’est à eux qu’il appartient de réduire au minimum les ennuis que suscite au public ce parchemin, tout en le conservant si c’est nécessaire. »

Dans tous les journaux, la passion est lisible : on espère que « l’entrave irritante de cette précaution inutile qu’est le passeport ne sera bientôt plus qu’un désagréable souvenir » ou souhaite que « les passeports, survivance inutile, onéreuse et vexatoire du passé, soient désormais supprimés ». L’émotion la plus fréquemment associée aux passeports est la colère : « stupide obligation », « honte de notre époque », « tare bureaucratique », « une des pires incommodités », « une source d’ennui pour qui voyage », « chiffon de papier », « formalité ridicule », « absurde », « humiliante », « brimade », « le passeport est une vaine sottise, un trompe-l’œil, un rien »… Lorsqu’un journal publie un témoignage d’usager, on s’excuse de devoir « supprimer les termes indignés qu’il emploie et les appréciations plutôt dures qu’il y exprime ».

En anglais, la « nuisance » des passeports

La presse ne réagit pas seulement en France. Comme l’a montré l’historien Craig Robertson, aux États-Unis les journaux qualifient la réaction négative du public de « nuisance du passeport » — l’équivalent de la « gêne » et des « vexations » françaises. Comme à Paris, on espère que l’obligation du passeport disparaîtra comme d’autres mesures prises en temps de guerre. On déplore le surcoût des voyages, comme dans cet article du New York Times de 1926 :

« Autrefois, on n’avait pas à se soucier des passeports, à moins de se rendre dans des contrées païennes. Mais la guerre a tout changé. Nous avons fini par imposer des frais de visa de dix dollars, et d’autres pays ont fait de même. Cela a généré des recettes, mais a aussi représenté une lourde charge financière pour les voyageurs. Les plaintes se sont multipliées, et le Congrès a été appelé à trouver une solution. »

Plus que le coût des voyages et la tracasserie administrative, c’est la réduction de la liberté de circulation que les médias déplorent. L’espoir d’un retour au régime de circulation d’avant-1914 survit même après la Seconde Guerre mondiale. Comme l’illustre cet article de 1947 :

« Une triste remarque sur ce progrès à rebours a été énoncée par la Chambre Internationale de commerce : en 1914, un homme d’affaires pouvait décider de se rendre d’une capitale à une autre et effectuer ce trajet en quelques heures seulement. Depuis 1914, les trains ont gagné en vitesse, l’automobile s’est généralisée et l’avion de ligne a fait son apparition. Mais l’homme d’affaires, ou tout autre voyageur, peut être contraint d’attendre des semaines, voire des mois, entre le moment où il prend sa décision et celui où il la met à exécution. La Chambre considère cette situation comme à la fois “absurde et pernicieuse” ».

Ce qui gêne

Il y a un siècle, nos arrière-grands-parents n’acceptaient pas d’attendre trois jours pour un passeport. Les temps ont changé. Aujourd’hui, les journaux nous invitent parfois à nous estimer « chanceux » lorsque l’attente ne dure que quelques mois. Comme ce titre, du même New York Times, “Besoin d’un passeport ? Vous avez de la chance” qui annonçait en 2024 :

« Pour la première fois depuis mars 2020, les délais de traitement sont revenus aux normales pré-pandémiques […] avec six à huit semaines pour le service standard et deux à trois semaines pour le service accéléré. »

Quand la contrainte n’est plus une gêne mais une chance, il nous reste l’embarras.

![]()

Speranta Dumitru ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d’une organisation qui pourrait tirer profit de cet article, et n’a déclaré aucune autre affiliation que son organisme de recherche.

– ref. La « gêne » du passeport, au-delà de l’administration Trump – https://theconversation.com/la-gene-du-passeport-au-dela-de-ladministration-trump-281912