Source: The Conversation – in French – By Viet Nguyen-Tien, Research Economist, London School of Economics and Political Science

La voiture électrique n’a plus besoin du prix du pétrole pour s’imposer : la baisse des coûts et les effets de réseau suffisent désormais à enclencher la transition. Mais en changeant de dépendance, elle redessine aussi les risques.

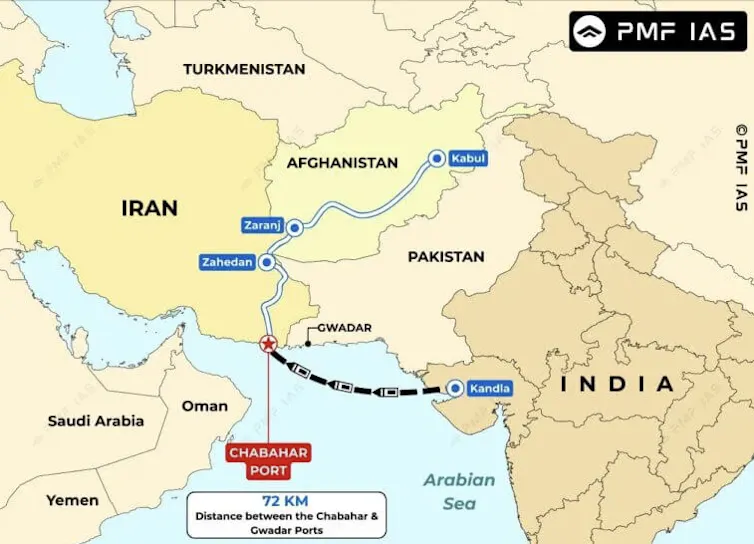

Lorsque le détroit d’Ormuz s’est retrouvé fermé pour la première fois en mars et que le baril de pétrole a atteint 120 dollars (101 euros), une très vieille question a refait surface : est-ce enfin le moment où les véhicules électriques vont réellement décoller — ou simplement un nouveau faux départ ?

Le secteur des véhicules électriques a déjà connu ce scénario. Il a émergé après l’embargo pétrolier de 1973, avant de s’effondrer avec la baisse des prix du pétrole, puis de repartir à la hausse. Chaque vague s’est éteinte lorsque la pression extérieure s’est relâchée.

Cette fois, selon nous, la situation est différente. Dans un récent document de travail, nous soutenons que le modèle économique des véhicules électriques s’améliore désormais pour des raisons qui lui sont propres. Cela tient à l’évolution des batteries, et non au prix du pétrole. Les mêmes éléments montrent toutefois que cette transition fait émerger de nouveaux problèmes, aussi sérieux que ceux qu’elle prétend résoudre.

Pourquoi cette fois est différente

Le coût des batteries a chuté de 93 % depuis 2010. C’est ce chiffre qui change tout. Un « pack » qui coûtait plus de 1 000 dollars (850 euros) par kilowattheure en 2010 ne coûtait plus que 108 dollars (91 euros) fin 2025, sous l’effet d’une décennie d’apprentissage, d’investissements et de politiques publiques favorables.

Des travaux sur l’industrie mondiale des batteries montrent qu’à chaque doublement de la production cumulée, les coûts baissent d’environ 9 %. Davantage d’acheteurs, davantage de production, des coûts plus faibles, donc encore plus d’acheteurs.

Contrairement aux années 1970, cette dynamique n’a pas besoin d’un choc pétrolier pour se maintenir. Les voitures électriques ont atteint la parité de coût sur l’ensemble de leur durée de vie avec les véhicules thermiques dans une grande partie de l’Europe ; sur le marché de l’occasion, elles affichent désormais le coût total de possession le plus bas. Les modèles récents égalent même les voitures essence en durée de vie estimée — ce dont les premiers véhicules électriques ne pouvaient pas se prévaloir.

Les ventes mondiales ont dépassé 17 millions d’unités en 2024, l’un des processus de diffusion technologique les plus rapides de l’histoire des transports. La Norvège est presque entièrement électrifiée. Et l’Éthiopie a atteint environ 60 % de parts de marché pour les véhicules électriques en 2024, portée par une électricité hydraulique bon marché — bien devant, par exemple, les États-Unis, autour de 8 %.

Une plateforme économique, pas seulement un moteur plus performant

La raison plus profonde pour laquelle cette vague ne s’essoufflera pas n’est pas technique — elle est économique. Un véhicule électrique est une plateforme. Sa valeur augmente à mesure que l’écosystème qui l’entoure se développe, de la même manière que les smartphones sont devenus indispensables non pas tant pour leur matériel que pour tout ce qui s’y connecte.

Chaque borne de recharge installée rend le véhicule électrique suivant plus attractif. Chaque mise à jour logicielle augmente la valeur de toutes les voitures déjà en circulation. Chaque batterie recyclée alimente la chaîne d’approvisionnement qui rend la suivante moins coûteuse. C’est aussi l’une des raisons pour lesquelles d’autres technologies, comme les véhicules à hydrogène à pile à combustible, peinent à se déployer à grande échelle : la technologie existe, mais l’ensemble des conditions nécessaires n’est pas encore réuni.

Une étude menée auprès de 8 000 conducteurs à Shanghai montre que l’angoisse de l’autonomie — la peur de tomber en panne de batterie — a un coût économique réel, en raison de trajets évités inutilement. Mais ce coût diminue rapidement, non pas parce que les batteries se sont améliorées, mais parce que les réseaux de recharge se sont étendus.

Rendre visible en temps réel la disponibilité des bornes pourrait ajouter entre 6 et 8 points de part de marché d’ici à 2030. Et comme la recharge des véhicules électriques est bien plus flexible que la plupart des autres usages domestiques de l’électricité, les conducteurs peuvent se détourner des heures de pointe avec une grande facilité lorsque le prix les y incite — transformant la voiture en un véritable atout pour le réseau, capable de stocker et de restituer de l’électricité selon les besoins. Il s’agit là d’effets de réseau économiques, et non de simples caractéristiques techniques.

Remplacer une dépendance par une autre

Mettre fin à la dépendance au pétrole ne supprime pas l’exposition géopolitique. Elle la déplace.

Fin 2025, la Chine a introduit des règles imposant une autorisation gouvernementale pour les exportations contenant plus de 0,1 % de terres rares. Le levier qui provenait autrefois du contrôle des flux pétroliers repose désormais sur la maîtrise des capacités de transformation et des chaînes d’approvisionnement en composants.

Les minerais en jeu — lithium, cobalt, nickel, graphite, néodyme, pour n’en citer que quelques-uns — comportent leurs propres risques géopolitiques et, comme nous l’avons montré ailleurs, des coûts humains importants pour les communautés qui les extraient. Cela alimente un cycle prévisible de contestation sociale qui menace de freiner la transition si l’industrie ne s’engage pas en faveur d’une innovation responsable et durable.

Le cobalt a longtemps permis aux véhicules électriques de parcourir de plus longues distances avec une même charge. Et lorsque les prix ont grimpé, la recherche s’est accélérée permettant de concevoir des batteries contenant moins de cobalt, voire pas du tout. Aujourd’hui, plus de la moitié des batteries de véhicules électriques vendues dans le monde n’en contiennent pas.

Des données sur quatre décennies de brevets montrent le même mécanisme : la hausse des prix des minerais réoriente systématiquement la recherche et développement vers des technologies plus économes en ressources.

La récupération du lithium et du cobalt à partir de batteries usagées devient elle aussi économiquement viable, déplaçant une partie de la chaîne d’approvisionnement loin des sites d’extraction exposés aux risques géopolitiques. Par ailleurs, la Norvège et d’autres pays cherchent à exploiter de nouvelles ressources en minerais critiques afin de diversifier les approvisionnements.

Une transition bien réelle mais non sans risques

La crise d’Ormuz rappelle le coût d’une dépendance énergétique concentrée. La transition vers les véhicules électriques n’en a pas besoin. La courbe d’apprentissage continue de baisser, la plateforme produit des effets cumulatifs, l’économie du modèle ne cesse de s’améliorer. C’est ce qui rend cette vague différente.

Ce qu’elle ne fait pas, en revanche, c’est éliminer les risques géopolitiques. Contrairement au pétrole, où le pouvoir repose sur les flux d’énergie, les chaînes d’approvisionnement des véhicules électriques concentrent le pouvoir autour des matériaux, des capacités de transformation et des goulets d’étranglement technologiques — des chaînes d’approvisionnement fortement concentrées et porteuses de risques sérieux. La dépendance au carburant devient une dépendance aux minerais. Et cette dépendance est, elle aussi, fortement concentrée.

Les régions automobiles traditionnelles absorbent déjà des pertes d’emplois concentrées, et l’histoire montre que ces bouleversements laissent des cicatrices durables, même lorsque les effets globaux à long terme sont positifs. Pourtant, l’assemblage des véhicules électriques se révèle plus intensif en main-d’œuvre dans les pays occidentaux que prévu — nécessitant davantage de travailleurs sur les chaînes de production, et non moins, du moins dans la phase de montée en puissance. À l’inverse, en Chine, l’automatisation massive a conduit à l’émergence d’« usines sombres » où la présence humaine est si réduite que l’éclairage n’est même plus nécessaire.

Les mêmes régions aujourd’hui confrontées aux pertes pourraient en tirer des bénéfices. Mais les gains et les pertes ne concernent pas les mêmes personnes. C’est là que réside encore l’essentiel du travail à accomplir.

![]()

Viet Nguyen-Tien reçoit des financements de l’ESRC via le Centre for Economic Performance (ES/T014431/1) et le Programme on Innovation and Diffusion (ES/V009478/1), et a précédemment été financé par la Faraday Institution dans le cadre du projet ReLiB (numéros de subvention FIRG005 et FIRG006).

Gavin D. J. Harper reçoit des financements de la Faraday Institution (numéros de subvention FIRG027, FIRG057 et FIRG085). Site du projet ReLiB : https://relib.org.uk/

Robert Elliott ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d’une organisation qui pourrait tirer profit de cet article, et n’a déclaré aucune autre affiliation que son organisme de recherche.

– ref. Batteries, coûts, réseaux… L’industrie automobile franchit le point de bascule et peut s’affranchir du pétrole – https://theconversation.com/batteries-couts-reseaux-lindustrie-automobile-franchit-le-point-de-bascule-et-peut-saffranchir-du-petrole-280924