Source: The Conversation – in French – By Ferney Osorio, Maître de Conférences en Génie Industriel et Management de l’Innovation, Université de Lorraine

Parés de bien des vertus, les fab labs, les living labs, les tiers-lieux et les labs d’innovation en général n’ont pas toujours été à la hauteur des promesses qui leur étaient associées. Dans ce domaine, le plus difficile est souvent de maintenir le projet de façon durable. Qu’est-ce qui fait la différence entre un lab qui réussit à créer à moyen terme et un autre qui échoue ?

Ils fleurissent partout : dans les universités, administrations, hôpitaux et entreprises. Équipés d’imprimantes 3D, couverts de post-its multicolores et porteurs d’une promesse séduisante : réinventer le monde grâce à l’innovation collaborative. Qu’on les appelle fab labs, makerspaces, tiers-lieux productifs ou encore living labs, tous partagent ce même élan d’ouverture. On recense aujourd’hui près de 1 900 fab labs dans le monde (fablabs.io), plus de 480 living labs labellisés dans 45 pays (ENoLL) et, rien qu’en France, plus de 4 100 tiers-lieux répartis sur tout le territoire (selon France Tiers-Lieux).

Pourtant, derrière l’enthousiasme initial, beaucoup de ces espaces finissent par tourner en rond. L’énergie s’essouffle, les résultats tardent à venir, le sens même du projet se brouille. Nos recherches récentes montrent que la raison de cet essoufflement réside souvent dans une dimension essentielle mais négligée : l’intention stratégique partagée.

À lire aussi :

Les tiers lieux : la fin d’une mode ou le début d’une nouvelle ère ?

Comment garder le cap

Qu’entend-on exactement par intention stratégique ? C’est la capacité d’un collectif à définir clairement et durablement son objectif central : ce que le lab cherche réellement à transformer, pour qui, et avant tout pourquoi. Cette intention est loin d’être un slogan figé sur un mur. Elle est plutôt comme une boussole, qui guide les équipes dans leurs choix quotidiens, leurs ajustements face aux imprévus, et leur permet de rester fidèles à leur mission initiale.

Bien sûr, toutes les organisations ont besoin d’une telle boussole. Mais pour les labs d’innovation, l’enjeu est encore plus vital. Ces espaces hybrides – à la croisée du public et du privé, du social et du technologique – naissent souvent comme des expérimentations fragiles. Ils évoluent dans des environnements instables, avec des financements incertains et des parties prenantes aux intérêts parfois divergents. Sans intention stratégique claire et partagée, ils risquent de se transformer très vite en coquilles vides, malgré tout le battage autour de l’innovation.

Or, nous avons observé dans plusieurs cas, en France mais aussi à l’international, que cette intention stratégique, si cruciale, est rarement définie clairement et encore moins revisitée régulièrement. Ces constats proviennent à la fois de ma recherche doctorale et de l’accompagnement d’initiatives de labs dans le cadre de projets européens et latino-américains (par exemple, Climate Labs ou, plus récemment, FabLabs4Innovation). Le résultat est souvent le même : un flou qui finit par provoquer frustration et perte de repères chez les membres du lab.

Intégrer ou protéger

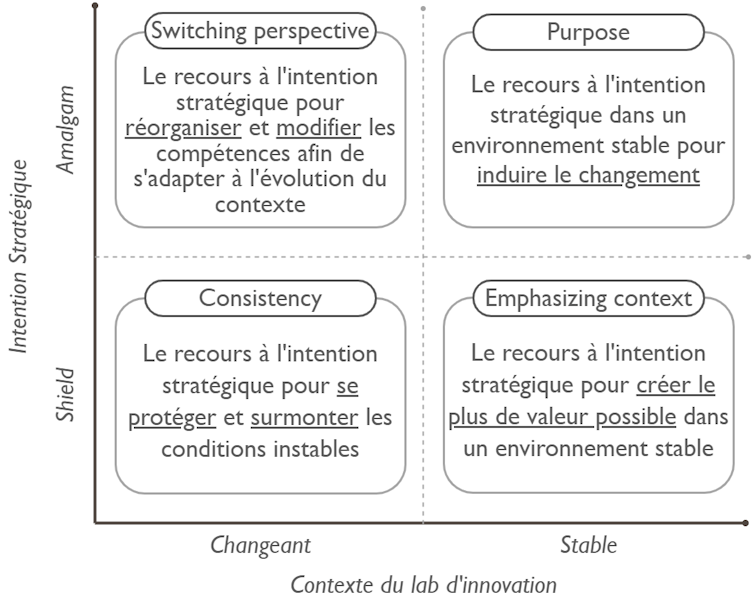

Nos recherches ont permis de dégager deux grandes approches pour construire et maintenir cette intention stratégique dans un lab d’innovation : la posture « amalgam » – intégrer des intentions multiples dans un cadre commun – et la posture « shield » – protéger l’intention initiale contre les pressions extérieures. Ces termes, issus de nos travaux récents, permettent d’illustrer deux manières contrastées de maintenir une intention stratégique partagée.

-

La posture « amalgam » consiste à intégrer plusieurs ambitions dans un projet collectif cohérent. Un excellent exemple est celui du fabLab Héphaïstos, à l’hôpital du Kremlin-Bicêtre (Val-de-Marne). Ce lab hospitalier a réussi à harmoniser trois grandes intentions : améliorer le soin aux patients, faciliter le travail des soignants et optimiser les processus internes. La clé de ce succès ? Une démarche collective régulière pour clarifier, revisiter et articuler ces intentions multiples dans un cadre commun.

-

La posture « shield », elle, consiste à protéger activement l’intention stratégique initiale contre les pressions extérieures. C’est l’approche adoptée par le Lab101 (ancien ViveLab Bogotá), en Colombie, qui, malgré des contextes politiques fluctuants, a réussi à garder un objectif clair : renforcer les capacités numériques et d’innovation des citoyens. Cette « protection de son éthos » leur a permis de maintenir le sens de leurs actions sur le long terme malgré les turbulences. Mais ces deux postures ne suffisent pas toujours. Le vrai défi est de savoir quand et comment les activer.

Trouver des points communs

Fondamentalement, l’intention stratégique prend ses racines dans des motivations individuelles et personnelles. Chaque individu porte ses propres attentes et visions. Mais dès lors qu’on décide de travailler ensemble, il est essentiel de trouver des points communs qui donnent naissance à une intention collective et organisationnelle. Comment savoir quand intégrer différentes visions, quand accepter une certaine fragmentation, ou quand préserver jalousement l’intention initiale ? Pour répondre à ces questions, nous avons conçu un cadre dynamique, permettant aux équipes d’ajuster et de faire évoluer leur intention stratégique au quotidien. Ce cadre repose sur quatre modes clés :

-

« Purpose » (Créer du sens) : Au démarrage du lab, il est crucial d’expliciter clairement et collectivement ce qu’on veut transformer, pour qui et pourquoi. Cette étape permet à tous les acteurs impliqués de comprendre exactement pourquoi le lab existe, et comment chacun peut y contribuer.

-

« Switching perspective » (Changer de perspective) : Quand le contexte change brusquement (changements politiques, nouveaux directeurs, nouvelles priorités), les équipes doivent être capables de réajuster leur angle d’approche sans perdre leur identité. Le cas du SDU-MCI Innovation Lab au Danemark illustre bien cette tension. Ce lab universitaire a connu des visions successives portées par différents responsables, chacune porteuse de nouvelles orientations. La difficulté résidait alors dans la capacité individuelle à maintenir une intention stratégique partagée, face à cette succession de perspectives parfois difficiles à intégrer. Résultat : confusion et perte d’énergie collective malgré des ressources considérables.

Forte capacité d’adaptation

-

« Emphasizing context » (Mettre l’accent sur le contexte) : Les labs doivent régulièrement adapter leurs priorités en fonction des réalités locales, des besoins des usagers ou des signaux faibles du terrain. Le Lab101 à Bogotá est exemplaire sur ce point. Grâce à une forte capacité d’adaptation à son contexte local, ce lab a pu amplifier le périmètre de ses actions et répondre de manière efficace aux évolutions du territoire et aux attentes des citoyens, tout en gardant son intention initiale.

-

« Building consistency » (Construire la cohérence) : Il s’agit ici de créer des ponts réguliers entre les actions concrètes menées au quotidien et l’intention stratégique définie au départ. Le Lorraine Fab Living Lab (LF2L) illustre parfaitement ce mode. Grâce à des discussions régulières au sein de son équipe, le LF2L a réussi à préserver la cohérence entre ses projets quotidiens et sa vision stratégique initiale, même face aux changements des priorités de son écosystème.

CC BY-NC-SA

Cette matrice simple (créer du sens, changer de perspective, insister sur le contexte, construire la cohérence) s’est révélée particulièrement utile pour permettre aux équipes d’innovation de ne pas se perdre en chemin, surtout dans des contextes changeants ou sous pression.

Des espaces vides de sens ?

Au-delà des résultats concrets immédiats, ce qui fait véritablement la force d’un lab d’innovation, c’est sa capacité à expliciter et à maintenir une intention partagée, claire et régulièrement actualisée. Sans cette intention stratégique, les labs risquent de devenir des espaces séduisants mais vides de sens, incapables d’engendrer une réelle transformation.

Finalement, le défi posé par ces labs d’innovation est avant tout un défi humain : il s’agit de construire et de maintenir une direction collective dans des environnements souvent complexes et mouvants. Ainsi, peut-être devrions-nous apprendre à mesurer l’innovation non seulement à travers les prototypes ou les succès immédiats, mais avant tout par la clarté et la solidité des intentions partagées par ceux qui l’incarnent au quotidien.

Redonner du sens à l’innovation collective est sans doute le meilleur moyen d’éviter que ces labs prometteurs ne perdent leur cap. Car une chose est sûre : pour innover profondément, il ne suffit pas d’avoir des ressources matérielles. Il faut savoir où l’on va, avec qui, et surtout pourquoi.

![]()

Ferney Osorio a reçu des financements de l’ANR et de MINCIENCIAS (Colombie). Il est également cofondateur du ViveLab Bogotá (aujourd’hui Lab101).

– ref. Pourquoi tant de labs d’innovation peinent-ils à trouver leur cap ? – https://theconversation.com/pourquoi-tant-de-labs-dinnovation-peinent-ils-a-trouver-leur-cap-264595