Source: The Conversation – USA – By Claire B. Wofford, Associate Professor of Political Science, College of Charleston

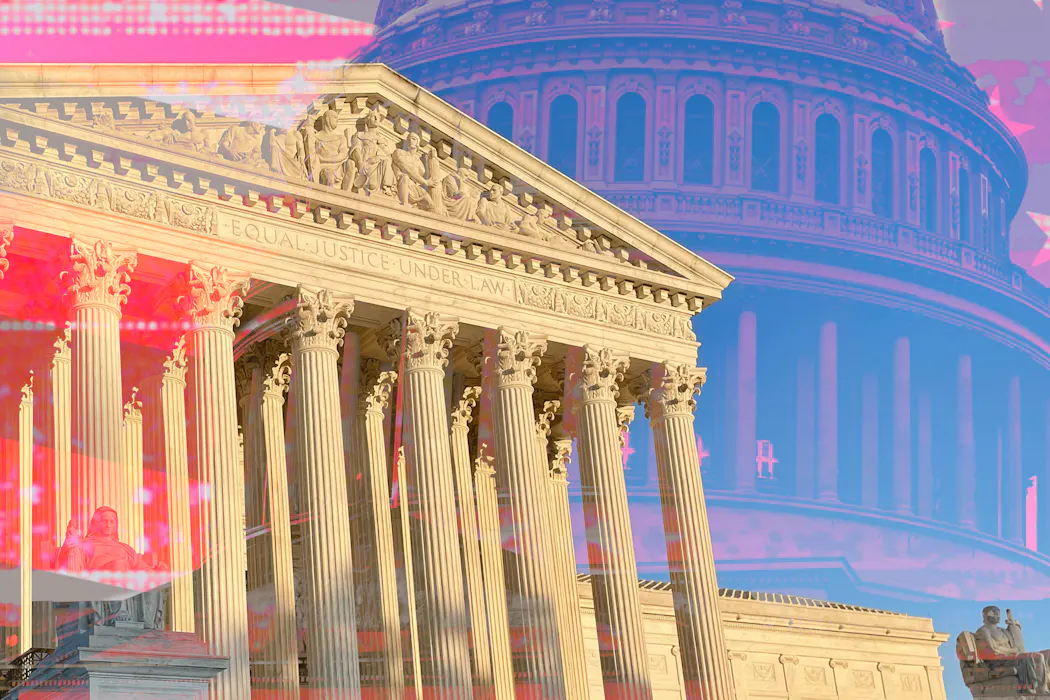

The outrage was swift and severe when the U.S. Supreme Court, by an ideologically divided 6-3 vote, recently struck down Louisiana’s majority Black congressional district as an unconstitutional racial gerrymander. Critics lambasted the court for gutting the Voting Rights Act, the federal law that had until recently garnered strong bipartisan support and had ensured Black political representation in the South for more than half a century.

Many analysts see Jim Crow-era disenfranchisement of Black voters on the horizon.

Whether Louisiana v. Callais will wreak this kind of havoc remains to be seen, although some Southern states have already begun to redraw their legislative districts, aiming to ensure Republican control. Several Black legislators – all Democrats – are expected to lose their seats in the upcoming midterm elections. Democrats are threatening to retaliate with their own redistricting plans.

Because of a 2019 decision by the court, such political gerrymanders, where a legislative district is crafted to ensure partisan control, cannot be challenged under federal law. Both parties had taken full advantage of that ruling.

Prior to the Callais ruling, however, legislators had to be sure that when they sought partisan control of a district, they did not excessively dilute the voting power of minority residents. Multiple lawsuits had challenged political gerrymanders on exactly these grounds.

After Callais, that guardrail is gone. Indeed, lest they provoke the same type of litigation faced by Louisiana, state legislators must now ignore the race of voters altogether. From here on out, gerrymandering is fine, but only if it’s race-neutral.

This does not mean, however, that the race-blind mapmaking process envisioned by the Supreme Court majority will manifest. Based on our recently published research, it may, in fact, be just the opposite.

Race, we found, is – at least in the South – a more reliable predictor of how someone will vote than their party identification. And that makes race, we believe, a potentially irresistible lure for those designing congressional districts.

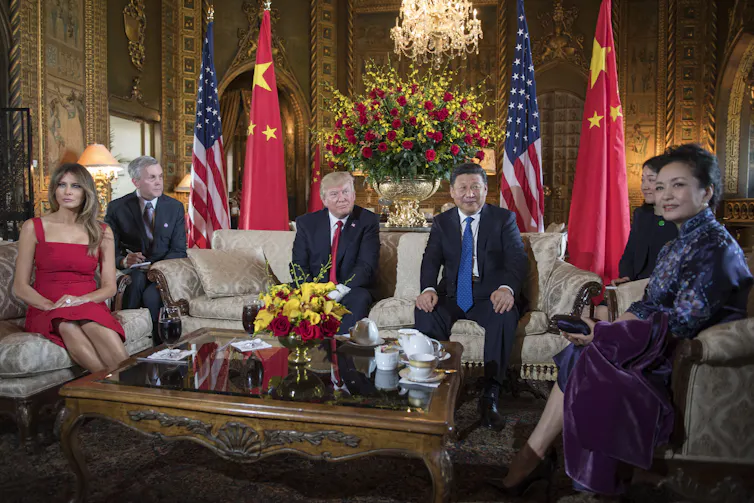

AP Photo

Race a more reliable predictor

We are both political scientists – one of us an expert on Congress and national elections and the other a constitutional law and Supreme Court scholar. In Southern states, race and political party overlap significantly, with the vast majority of Black voters favoring Democrats and most white voters favoring Republicans. And in our study, we document that in this region, mapmakers actually have an incentive to take race into account when conducting a political gerrymander.

Political gerrymandering is the process of drawing electoral districts to favor one party over another. In most states, the responsibility for drawing districts rests with the state legislature. Thus, the party that controls state legislatures very often controls elections – at both the state and congressional level.

The goal of partisan redistricting is to maximize the chance that candidates from that political party will win elections. Our study shows that using both the race and party of voters to redraw districts, rather than just party alone, better ensures partisan advantage.

The research we conducted was motivated by a claim made by Justice Samuel Alito in another recent racial gerrymandering case decided by the Supreme Court, Alexander vs. South Carolina NAACP. He argued in the court’s majority opinion that when drawing districts to favor one party, mapmakers would need to look only at voters’ party affiliation – their race would be irrelevant to ensuring partisan control.

It is a straightforward, seemingly sensible claim. It is also wrong.

Our study uses an original dataset of precinct-level election results in South Carolina from 2010 to 2020 to explore how well a precinct’s racial and partisan composition before redistricting predicts how it votes over the following decade.

What we found reveals a more complicated picture than Alito – and the subsequent Callais decision – presumes.

A precinct’s Democratic and Republican vote share prior to redistricting was the strongest predictor of future election results. But there are two problems with relying on only such partisan data when gerrymandering a district.

First, our analysis showed that roughly a quarter of a precinct’s voters in the next election did not follow what the partisan data predicted – a sizable amount, given the supposed ease of gerrymandering by party.

Second, precinct election results are surprisingly volatile. Our analysis shows that the effect of preredistricting partisanship varies with election cycles, national conditions, gradual changes in party coalitions and other factors. A precinct that leaned Republican in the election before redistricting may vote very differently in a midterm wave year when the president is unpopular, precisely the type of election coming in November.

By comparison, the analysis shows that voters’ race is a more reliable predictor than their party of how they will vote in the next election. Consequently, it seems that, at least in Southern states, legislators have a genuine, data-driven incentive to use racial data when drawing partisan districts.

Kevin Wolf/AP Photo

Will race still affect political gerrymanders?

Consider this redistricting scenario: South Carolina’s Republican-led legislature wants to flip the state’s lone Democratic congressional seat – long held by prominent African American U.S. Rep. Jim Clyburn – for the 2026 midterms. A simple approach is to identify those who voted for Donald Trump in 2024 and then just redraw the district to add enough of those voters to ensure Republican control.

The plan backfires, however. Not only does Clyburn hold his seat, but a neighboring district also elects a Democrat. What went wrong?

Simply put, the legislature failed to realize that past partisan returns are an imperfect predictor of future voting behavior.

A heavily Democratic area that is predominantly Black will vote Democratic far more consistently than a heavily Democratic area that is predominantly white. Two precincts that look identical on a partisan map can behave very differently at the ballot box. And a legislature that fails to take this into account has taken an unreliable route to partisan advantage.

If Republican legislators want to oust Democratic officials, the most reliable route is to oust from a district the minority Democratic voters who would have elected them.

This is not to suggest that legislators should use race in this way. It certainly smacks of racism and echoes the type of electoral machinations used during Jim Crow. But that analogy is not exactly on point. The approach we identified targets the power of Black voters not because they are Black, but because they are such reliable Democrats.

To many, that may be a difference that makes no difference. More litigation over gerrymanders is inevitable. If litigants can demonstrate that race was a “predominant” factor that “drove” redistricting, or that mapmakers purposefully attempted to diminish the power of Black voters because of their race, legal liability can still follow.

Voting rights advocates should be aware of the temptation legislators may have to let race affect their political gerrymanders.

Perhaps minority voters are as free from invidious discrimination as Alito’s majority opinion in the Callais case suggests. This does not mean, however, that those charged with ensuring all voters are fairly represented in American democracy will be colorblind. Our findings show that race could easily remain embedded in the political gerrymandering landscape, despite vehement claims to the contrary.

![]()

Jordan Ragusa has served as an expert witness in racial gerrymandering litigation, most notably in Alexander v. South Carolina State Conference of the NAACP. He also serves on the advisory board of Charleston Civil Rights and Civics (C3), an educational non-profit that fosters civic engagement and civil rights awareness among high school students

Claire B. Wofford does not work for, consult, own shares in or receive funding from any company or organization that would benefit from this article, and has disclosed no relevant affiliations beyond their academic appointment.

– ref. Racial gerrymandering may be here to stay – https://theconversation.com/racial-gerrymandering-may-be-here-to-stay-282349