Source: The Conversation – France (in French) – By Guillaume Christen, Maître de conférences à l’Université de Strasbourg, docteur en sociologie de l’environnement, Université de Strasbourg

Les biocides utilisés dans les produits de nettoyage, en particulier pour la désinfection des bâtiments publics, participent à la pollution de l’eau. Pourtant, des alternatives existent, mais faire évoluer les pratiques est difficile. En cause, la méconnaissance des risques au sein de la filière ainsi que l’organisation du travail actuelle.

Nous manipulons au quotidien des produits contenant des biocides, par exemple pour l’entretien de la maison, l’hygiène personnelle, la lutte contre les nuisibles, etc. En milieu urbain, leur utilisation s’est diffusée dans de nombreuses activités : construction, nettoyage, entretien des espaces verts, etc. On y recourt, par exemple, pour la protection des revêtements de façade afin de lutter contre les mousses et moisissures ou dans des usages domestiques tels que l’hygiène et l’entretien des bâtiments (sols, sanitaires…).

Or, l’utilisation de ces substances contribue à une dégradation de la qualité des eaux. Les solutions envisagées privilégient généralement un traitement des micropolluants après usage. Toutefois, les stations d’épuration ne retiennent que partiellement les molécules polluantes.

Ce constat invite à repenser les usages et à étudier la possibilité d’une réduction à la source. Mais renoncer aux biocides n’est pas une évidence. En effet, il s’agit d’un enjeu environnemental mal identifié par la population. Il requiert aussi des changements de pratiques susceptibles de se heurter à des formes d’inertie.

La question du renoncement aux biocides pour la désinfection (bactéricides, virucides, fongicides) est particulièrement sensible. C’est encore plus vrai dans les secteurs de la petite enfance et de la maintenance de bâtiments municipaux.

Les pratiques en place pour nettoyer les bâtiments publics

Pour comprendre ces enjeux, nous avons mené une enquête sociologique à l’échelle de l’eurométropole de Strasbourg. Celle-ci se fonde sur une trentaine d’entretiens semi-directifs réalisés auprès de la chaîne des acteurs du secteur du nettoyage, en particulier le personnel d’entretien, les responsables techniques et les fournisseurs.

Nous nous sommes appuyés sur l’idée d’une réduction des biocides à la source, à partir du concept de « redirection écologique ». Il ne s’agit pas de simplement optimiser les pratiques existantes, mais bien d’abandonner l’utilisation de certains produits susceptibles de contenir des biocides nocifs.

Dans l’enquête, nous avons cherché à comprendre comment les professionnels de la filière du nettoyage peuvent innover différemment, en utilisant moins de produits chimiques, soit en considérant des alternatives comme la désinfection à la vapeur, soit en privilégiant des composés plus naturels tels que l’acide lactique.

À lire aussi :

Comment limiter le recours aux produits biocides dans les enduits de façades ?

Des micropolluants omniprésents, en particulier les ammoniums quaternaires

Les biocides, dont l’étymologie désigne l’action de neutraliser « les vivants indésirables », sont qualifiés de « micropolluants » en raison de leur faible concentration dans les systèmes aquatiques urbains. Bien que présents en petite quantité, leur impact toxicologique notable sur l’environnement et la santé humaine nécessite notre attention.

Les sources sont, en effet, nombreuses : traitements antibiotiques, PFAS, peintures de façade ou encore désinfectants domestiques, objet de notre propos.

Afin d’assurer la désinfection de certaines surfaces (sols, tables, sanitaires, points de contact), professionnels et particuliers ont recours à l’utilisation de biocides nommés « ammoniums quaternaires » (ou « QUATS »). Or, leur persistance dans l’environnement est préoccupante. Bien qu’il existe d’autres méthodes de désinfection (acide lactique, nettoyage à la vapeur), l’usage de QUATS est la pratique dominante, en partie en raison de leur utilisation reconnue dans le milieu médical. S’il n’est pas possible de quantifier le volume de QUATS introduits dans l’environnement, leur prédominance dans les usages en fait un sujet de santé environnementale, dans une démarche One Health).

Le nettoyage étant une compétence municipale, une commune peut renoncer à l’usage de ces composés. Toutefois, le risque « biocide » est mal identifié par les différents acteurs de la chaîne, ce qui complique sa transmission vers les agents d’entretien qui les manipulent au quotidien.

Un risque invisibilisé par l’« effet de filière »

Il existe en effet un « effet de filière » qui entraîne la délégation de la confiance à des acteurs spécialisés. Cela se traduit par une mise à distance, pouvant être à l’origine d’une « capacité empêchée » des professionnels à formuler une préoccupation environnementale quant à l’usage d’un produit.

Cela se manifeste par une méconnaissance de la composition des produits utilisés, tout au long de la chaîne d’acteurs. Cette perte de savoir s’observe dès les fournisseurs, incapables de transmettre l’information aux responsables techniques et eux-mêmes aux agents. Après usage, les eaux contenant les produits de nettoyage sont collectées et traitées en stations d’épuration. Leur gestion discrète invisibilise le devenir des eaux de nettoyage et la compréhension courante de l’enjeu.

Dans ce contexte, les services techniques de nettoyage, notamment ceux des municipalités, ne font pas de la composition du produit un critère de choix. Ils font confiance aux fournisseurs-producteurs, explique un coordinateur des agents d’entretien d’un établissement scolaire :

« Nous, on est l’utilisateur, on n’est pas le fabricant, donc nous, on arrive à la fin de la chaîne. Nous, on arrive, on dit : “Moi, je veux un produit pour nettoyer.” Après c’est lui, le concepteur, qui dit : “Bah, voilà pour cette tâche, il faut tel grammage, il faut ceci, cela.” Moi, ça, ce n’est pas mon souci. »

Acteurs clés de la filière, fabricants et fournisseurs interviennent dans la définition des pratiques de nettoyage. Ces derniers vendent non seulement des produits d’entretien, mais aussi les préconisations d’application (le type de surface, la fréquence d’utilisation, la préparation, le dosage pour dilution ou encore la méthode de nettoyage), que les agents d’entretien respectent.

Les professionnels perdent ainsi la « trace » et la « mémoire » de la composition chimique des produits d’entretien ainsi que de leurs impacts possibles sur les milieux.

Des alternatives à s’approprier

Désinfecter avec des biocides nocifs (QUATS) n’est pourtant pas inéluctable. L’acide lactique et la vapeur sont deux alternatives déjà utilisées par certains professionnels engagés dans une démarche écologique plus générale. Elles incarnent l’idée d’innover par le « retrait » en incitant à « faire sans » (vapeur) ou « avec moins » (acide lactique).

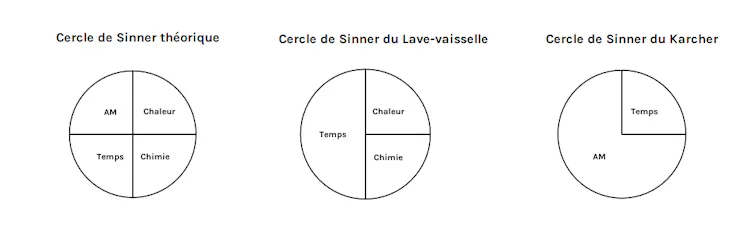

Ces alternatives qui innovent sans apporter de technologie supplémentaire peinent toutefois à susciter la confiance, dans un contexte où l’innovation technique apparaît comme la clé de lecture légitime. Ces réticences s’expliquent par le fait que l’efficacité est le critère principal servant à juger de la qualité d’un protocole de nettoyage. Or, selon le cercle de Sinner, cette efficacité dépend de quatre facteurs : le temps d’application, l’action mécanique (AM), la température et la chimie utilisée.

ManonM12/Wikimédia

L’utilisation d’une chimie moins « agressive » se traduit par une augmentation d’au moins un des trois autres facteurs. Ce qui entraîne la modification des pratiques historiques ou même de l’organisation du travail (planning horaire, achat de machines). En d’autres termes, pour nos interlocuteurs, simplifier la chimie du nettoyage revient à complexifier l’organisation quotidienne, freinant l’adhésion aux alternatives.

Le renoncement aux biocides pour l’hygiène suppose de cerner les principaux acteurs impliqués, leur niveau de conscience des impacts (notamment sur la santé et sur l’eau) et les obstacles à l’utilisation d’alternatives. Retrouver des eaux urbaines de qualité et sans pollution est aussi un enjeu d’adaptation dans un contexte de crise écologique : leur réemploi constitue un levier majeur face aux aléas climatiques, par exemple lors des canicules et sécheresses.

ReactiveCity est financé par le programme Interreg VI Rhin supérieur. La recherche associe des chercheurs du département d’hydrologie de l’Université Albert-Ludwig de Fribourg-en-Brisgau (Allemagne), du Groupe de travail sur l’écotoxicologie fonctionnelle aquatique (Université de Coblence-Landau), de l’Institut de chimie durable et de chimie de l’environnement (Université de Leuphana Lüneburg), de l’Institut Terre et environnement de Strasbourg (Ites, porteur du projet) ainsi que du laboratoire Sociétés, acteurs, gouvernement en Europe (Université de Strasbourg).

![]()

Guillaume Christen a reçu des financements de l’Union européenne dans le cadre du projet Interreg 6 Rhin supérieur « ReactiveCity : vers une ville pro-active sans biocides » (sept. 2023 – août 2027).

Louise Negri a reçu des financements de l’Union européenne dans le cadre du projet Interreg 6 Rhin supérieur « ReactiveCity : vers une ville pro-active sans biocides » (sept. 2023 – août 2027).

Philippe Hamman a reçu des financements de l’Union européenne dans le cadre du projet Interreg 6 Rhin supérieur « ReactiveCity : vers une ville pro-active sans biocides » (sept. 2023 – août 2027).

– ref. Crèches, écoles… les bâtiments publics au défi d’un nettoyage moins polluant – https://theconversation.com/creches-ecoles-les-batiments-publics-au-defi-dun-nettoyage-moins-polluant-278630