Source: The Conversation – (in Spanish) – By Anna Peirats, Catedrática de Humanidades, Universidad Católica de Valencia

A finales de enero muchas universidades celebran un acto solemne dedicado a un maestro medieval, Tomás de Aquino, referente del saber desde el siglo XIII. Su figura contribuyó a sentar las bases de la docencia y de la investigación universitaria.

París: formación y método

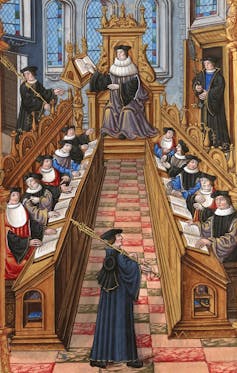

Tomás de Aquino llegó a la Universidad de París hacia 1245, un centro que se había consolidado como uno de los focos intelectuales más dinámicos de Europa. Allí accedió al grado de bachiller bíblico, centrado en la lectura y comentario de la Sagrada Escritura, y más tarde alcanzó el grado de bachiller sentenciario.

Biblioteca Nacional, París / Gallica

Tomás de Aquino asimiló el método escolástico característico de la universidad medieval, que integraba la lectura y el comentario de textos, el planteamiento argumentado de problemas teóricos y el debate entre maestros y estudiantes. Su pensamiento tuvo un papel decisivo en la integración del aristotelismo en la universidad medieval. Al mismo tiempo, articuló una relación ordenada entre razón y fe orientada a la búsqueda de la verdad y la Iglesia Católica le consideró doctor angélico, doctor común y doctor de la humanidad.

Sus obras Summa theologiae y Summa contra gentiles circularon en las universidades europeas y se incorporaron a la enseñanza reglada. Estos textos contribuyeron a fijar criterios rigurosos de argumentación y método para la comunidad científica.

El reconocimiento universitario

Durante la década de 1250 la Universidad de París atravesó una crisis institucional de gran alcance. En 1253 los maestros seculares interrumpieron de forma colectiva la enseñanza, como respuesta a un conflicto con las órdenes mendicantes de los dominicos y los franciscanos por el acceso a las cátedras. El enfrentamiento cuestionó el estatuto académico de estas órdenes y derivó en su exclusión temporal de la universidad. Entre los afectados se encontraba Tomás de Aquino. El conflicto se resolvió tras la intervención del papa Alejandro IV mediante la bula Quasi lignum vitae, que les autorizaba a continuar con sus escuelas públicas y a acceder a las cátedras de la universidad.

Un año después, Tomás de Aquino recibió la licencia para enseñar Teología (licentia docendi), lo que le otorgó plena legitimidad académica. El inicio público de su magisterio en Sagrada Escritura quedó marcado por la lección inaugural de 1256 en París, con el discurso conocido como Rigans montes. Para esa ocasión eligió el versículo del Salmo 103: “Rigans montes de superioribus suis; de fructu operum tuorum satiabitur terra” (“Regando los montes desde arriba, la tierra se saciará del fruto de tus obras”).

Esta imagen ofrece una clave para comprender el orden del saber. La doctrina procede de lo alto y llega a la comunidad académica a través de quienes han recibido autoridad para enseñar. El doctor transmite un conocimiento que exige método, precisión y responsabilidad en el uso de la palabra. En esta figura se reconoce un modelo de rigor académico, servicio a la verdad y continuidad de la tradición universitaria.

La autoridad que la universidad reconoció a Tomás de Aquino se vio reforzada más tarde por el reconocimiento eclesial. El papa Juan XXII lo canonizó el 18 de julio de 1323 con la bula Redemptionem misit. Más tarde, Pío V lo proclamó doctor de la Iglesia (1567).

La memoria material de Tomás de Aquino se vincula a la abadía de Fossanova (en el centro de Italia), lugar donde murió en 1274. Allí permaneció su cuerpo durante casi un siglo, depositado en un sarcófago que hoy se conserva como testimonio histórico.

Una fecha cambiante

Su conmemoración litúrgica se fijó en un primer momento el 7 de marzo, fecha de su muerte. Esta elección planteó dificultades, ya que coincidía con frecuencia con la Cuaresma, periodo en el que se restringían los actos públicos y las ceremonias académicas.

La situación cambió cuando el papa Urbano V ordenó el traslado de las reliquias de Tomás de Aquino a Toulouse, en Francia. La recepción tuvo lugar el 28 de enero de 1369 en el convento de los Jacobinos, antiguo convento de la Orden de los Predicadores, donde se conservan en la actualidad.

Didier Descouens/Wikimedia Commons, CC BY-SA

Entre los siglos XIV y XV, las universidades europeas adoptaron esta fecha como marco adecuado para ceremonias institucionales. No obstante, la configuración definitiva de la festividad se produjo en el siglo XX. Este proceso se inscribe en la reforma del calendario litúrgico posterior al Concilio Vaticano II. En 1969, el papa Pablo VI promulgó la carta apostólica Mysterii Paschalis, en la que se estableció el criterio de mantener en el calendario común solo aquellas celebraciones consideradas de valor universal para la Iglesia.

Así, la conmemoración religiosa de Tomás de Aquino quedó fijada el 28 de enero, una decisión que proporcionó un marco litúrgico estable.

Difusión europea y continuidad institucional

La memoria de Tomás de Aquino recibió un respaldo institucional cuando León XIII publicó Aeterni Patris (1879). Esta encíclica consideró su pensamiento como eje fundamental de la enseñanza superior frente a las corrientes materialistas de su tiempo. Un año después, el breve Cum hoc sit (1880) lo declaró patrono de las universidades y escuelas católicas.

Con estas disposiciones, León XIII presentó a Tomás de Aquino como referente intelectual para la investigación y la enseñanza superior. En España, una Real Orden publicada en 1922 reconoció la festividad de Santo Tomás de Aquino como Fiesta del Estudiante.

GrandPalaisRmn (musée du Louvre) / Hervé Lewandowski

De esta manera, se aseguró su continuidad como acto institucional en el sistema universitario. La celebración se difundió junto con el modelo parisino por universidades de toda Europa. Fuera de este continente, el arraigo es también significativo en Filipinas.

Solemnidad y simbolismo académico

La festividad de Santo Tomás se asocia desde la Edad Media a la figura del doctor universitario y en el acto se hace visible la dimensión pública de la autoridad intelectual. La ceremonia se acompaña de cantos solemnes, y los signos externos –la toga, el birrete, el libro y el anillo– refuerzan su significado. En conjunto, poseen un valor institucional y una continuidad de la tradición universitaria.

La pervivencia de esta celebración responde a la continuidad de un modelo de universidad más que a una lógica confesional. En centros que mantienen una relación con el calendario litúrgico romano, Tomás de Aquino se integra en los actos solemnes del curso académico. En otros contextos, formados en tradiciones anglicanas o protestantes, es un referente intelectual de la comunidad científica. Esta diversidad de enfoques permite entender cómo su legado se ha asumido de distintas maneras en la transmisión del saber a lo largo de la historia. En su figura, la comunidad científica reconoce un modelo de rigor intelectual y de estudio orientado a la búsqueda de la verdad.

Por este motivo, celebramos cada 28 de enero al maestro que otorgó a la razón un estatuto de autoridad universitaria y que definió la investigación como una responsabilidad institucional.

![]()

Las personas firmantes no son asalariadas, ni consultoras, ni poseen acciones, ni reciben financiación de ninguna compañía u organización que pueda obtener beneficio de este artículo, y han declarado carecer de vínculos relevantes más allá del cargo académico citado anteriormente.

– ref. ¿Por qué la universidad celebra a santo Tomás de Aquino cada 28 de enero? – https://theconversation.com/por-que-la-universidad-celebra-a-santo-tomas-de-aquino-cada-28-de-enero-273717