Source: The Conversation – France (in French) – By Antoine Weidmann, Doctorant en histoire contemporaine, Université Bordeaux Montaigne

Le 26 avril 1986, la centrale nucléaire de Tchernobyl bascule dans l’histoire. Qui est responsable de la catastrophe, la plus grave de l’histoire du nucléaire civil ? L’examen de la chaîne de responsabilités est complexe, entre défauts techniques et organisationnels et gouvernance politique partagée entre deux ministères. La catastrophe témoigne aussi d’une culture de la sûreté nucléaire bien différente de ce qu’elle est aujourd’hui en occident.

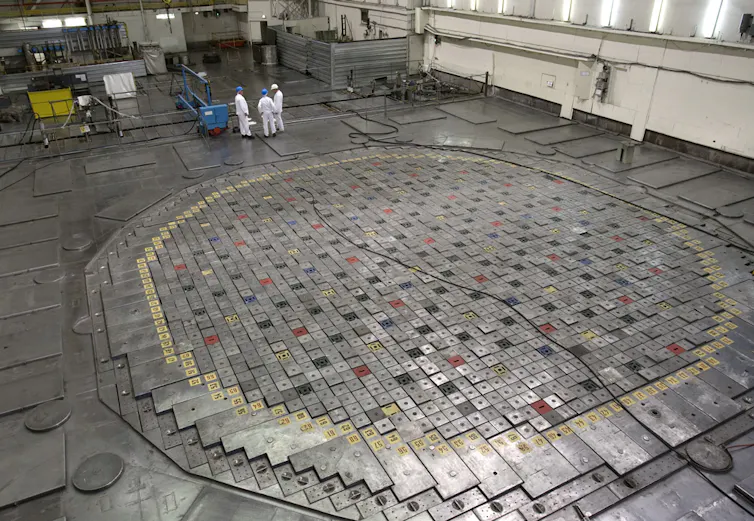

Il y a 40 ans, à 1h23 du matin, le 26 avril 1986, le réacteur N°4 de la centrale nucléaire Vladimir Ilitch Lénine, située à Tchernobyl, en actuelle Ukraine, explose. Cet évènement représente la catastrophe nucléaire la plus grave de l’histoire nucléaire soviétique et mondiale.

L’accident se produit au cours d’un test de sécurité de l’unité n°4 de la centrale, qui s’emballe alors à plus de 100 fois sa puissance nominale, conduisant à la fusion du cœur du réacteur puis à l’explosion de celui-ci. En cause, une série de défaillances humaines et techniques. La catastrophe prend de court toutes les autorités soviétiques par son ampleur. Après avoir, dans un premier temps, minimisé la gravité de l’accident, celles-ci sont rapidement confrontées à la réalité du désastre.

À ce moment précis, il n’est pas certain que les dirigeants aient pleinement conscience de toutes les conséquences de l’accident. Mais les défauts du complexe nucléaire soviétique, tant en matière de conception que de procédures, étaient connus, en tout cas par certains dirigeants et scientifiques.

Peut-on retracer la chaîne des responsabilités ayant conduit à l’accident ? L’exercice est périlleux : la responsabilité de l’accident repose sur un concours de circonstances, permis par les failles d’un système technique et organisationnel très différent de celui qui structure aujourd’hui la sûreté nucléaire en Europe.

La technologie RBMK, instable par conception

La construction de la centrale nucléaire Lénine à Tchernobyl débute en 1970. Elle aboutit à la mise en service de quatre réacteurs entre 1978 et 1984. En 1986, année de la catastrophe, un cinquième réacteur est encore en cours de construction depuis 1981. La centrale est située dans le nord de l’Ukraine proche de Kiev et de la frontière avec la Biélorussie. Son refroidissement par eau est assuré par la rivière Pripiat, un affluent du Dniepr qui se jette dans la mer Noire.

Les réacteurs de la centrale sont de type RBMK (pour Reaktor Bolshoy Moshchnosti Kanalnyi, soit réacteur de grande puissance à tubes de force, en français) comme environ la moitié du parc nucléaire soviétique à cette période. Il s’agit d’un réacteur refroidi à l’eau et modéré au graphite.

Cette technologie, propre à l’Union soviétique, dispose d’avantages, notamment en termes de maintenance et d’approvisionnement en isotopes, puisqu’il permet de produire du plutonium, utile dans le cadre d’un programme nucléaire militaire. Mais sa conception le rend instable.

En effet, le réacteur RBMK est conçu en faisant appel à un coefficient de vide positif. Il permet de caractériser l’évolution de la réactivité dans le cœur en cas de diminution de la densité du fluide caloporteur, par exemple en cas de fuite. Le coefficient de vide décrit donc la tendance spontanée du réacteur à augmenter sa puissance (coefficient positif), à rester dans un état stable (coefficient nul), ou à diminuer spontanément sa puissance (coefficient négatif, soit l’arrêt progressif de la réaction en chaîne), ce qui est le cas des réacteurs à eau pressurisée français.

De par ce coefficient de vide positif, les réacteurs RBMK sont fondamentalement instables et doivent être régulés grâce à l’action des opérateurs. De ce fait, il existe un risque d’emballement de la réaction en chaîne, pouvant jusqu’à conduire à la fusion du combustible nucléaire, comme cela fut le cas à Tchernobyl. Les ingénieurs soviétiques se devaient donc d’être très soucieux de la stabilité du réacteur.

D’autres contraintes techniques pèsent sur les opérateurs, comme la présence de graphite à l’extrémité des barres de contrôle, qui est inflammable. Ceci augmente la réactivité dans le cœur du réacteur au début de leur insertion, ce qui peut devenir déstabilisant si un grand nombre sont insérés en même temps, comme lors d’un arrêt d’urgence.

Ce n’est pas tout : le bouton AZ5, qui permet de déclencher la procédure d’arrêt d’urgence de la centrale RBMK, met plus de vingt secondes à fonctionner, ce qui accroît encore les risques de perte de contrôle de la réaction en chaîne.

Kuba Daneck, CC BY

Au sein des centrales RBMK de l’époque, il existait une consigne informelle : ne pas diminuer la puissance du réacteur sous les 700 mégawatts (MW) thermiques de manière prolongée et toujours laisser trente barres de contrôle au minimum dans le cœur du réacteur. Ces consignes ont été outrepassées à Tchernobyl.

À lire aussi :

Que sont devenus les réacteurs RBMK ?

En 1975 déjà, des incidents sur une centrale RBMK

Après la catastrophe de Tchernobyl, dans un contexte de réformes politiques, Mikhaïl Gorbatchev, veut encourager la transparence sur la situation. Le 14 mai 1986, lors d’une allocution télévisée, il prend la parole pour rendre compte de la situation sur place, signe fort d’un changement des usages politiques soviétiques.

Suite aux pressions internationales – et en particulier de l’Agence internationale de l’énergie atomique (AIEA) –, le comité central du parti communiste conduit alors, dès juillet 1986, une enquête partiellement publique afin d’identifier les causes des évènements survenus dans le réacteur N°4.

Cette enquête apporte des éléments de culpabilité, toutefois répartis entre les concepteurs, les opérateurs et les régulateurs, tout en démettant une série de responsables hiérarchiques, jusqu’à Efim Slavski, à la tête du ministère de l’ingénierie mécanique semi-lourde (Sredmash), alors partiellement en charge de l’énergie nucléaire, cette responsabilité étant partagée avec le ministre de l’énergie de l’électrification (Minenergo).

Katholitzky, Stefan (copyright), IAEA-ARC-AV-PH-01-02-A2789-003

A la fin de l’été 1986, un sommet est organisé à Vienne par l’AIEA, où les soviétiques annoncent révéler l’intégralité de la catastrophe pour obtenir une expertise occidentale.

Les scientifiques soviétiques ont alors une consigne de transparence, à rebours de la culture du secret qui prévalait jusqu’alors. Une telle autorisation de divulguer des éléments techniques, tout en préservant l’industrie nucléaire comme élément stratégique au développement soviétique, est inédite pour l’URSS.

La délégation soviétique, dans le rapport qu’elle présente aux experts, pointe quatre facteurs déterminants qui ont conduit à la catastrophe :

Report on the Visit of a U. S. Nuclear Safety Delegation to the Soviet Union, August 19-31, 1988

-

des procédures suboptimales,

-

leur transgression par les opérateurs,

-

des conséquences radiologiques mal prises en compte,

-

ces dernières ayant mené à une évacuation tardive de la ville de Pripiat.

À la suite de la conférence, un groupe d’experts de l’AIEA est constitué. Il livre son rapport en septembre 1986. Par la suite, le rapport présenté par la délégation soviétique est classifié, après que certains passages aient été publiés dans la Pravda. Le rapport de l’AIEA y est également publié.

À noter que la technologie des réacteurs de type RBMK avait déjà été remise en cause plus de 10 ans avant la catastrophe. En 1975 déjà, plusieurs incidents étaient survenus sur la centrale de Leningrad, qui avaient alors été étouffés par les responsables locaux de la centrale. On retrouve des problèmes liés à la conception mais aussi à la qualité de la construction et à l’organisation.

Autrement dit : la délégation soviétique présente à la conférence de Vienne, en août 1986, ne peut dissimuler sa connaissance des problèmes soulevés par l’AIEA. Si la dimension technique est essentielle, couplée à l’enchaînement improbable des évènements, les experts de l’AIEA concluent que les principales causes de l’accident sont humaines et organisationnelles, même s’ils refusent dans le même temps de considérer qu’elles relèvent seulement de l’erreur humaine.

Culture du secret, absence de redondance… une approche différente de la sûreté nucléaire

Pour comprendre la catastrophe, il faut revenir sur la vision qu’a alors le système politique soviétique de la sûreté nucléaire.

La culture du secret, héritée du programme nucléaire militaire soviétique, n’a pas permis de récolter, comme ailleurs, les fruits des retours d’expérience d’incidents nucléaires. Au contraire, elle a créé une fracture importante dans la perception du risque entre les concepteurs et les opérateurs des centrales.

Ces derniers dépendent d’ailleurs de deux ministères distincts : les concepteurs des centrales dépendent du ministère de l’ingénierie mécanique semi-lourde (Sredmash) et les opérateurs du ministère de l’énergie et de l’électrification (Minenergo).

La culture du secret concerne surtout le premier (Sredmash), qui est l’héritier du programme nucléaire militaire. La rétention d’informations y est forte vis-à-vis du Minenergo. Or, l’industrie nucléaire soviétique s’est bâtie depuis les années 1950-1960 autour de la relation ambivalente de ces deux ministères, dont les chevauchements de compétences sont nombreux.

Le principe de redondance (qui consiste à doubler, voire tripler ou quadrupler les systèmes de sûreté pour faire face aux cas de dysfonctionnement) est globalement absent des centrales nucléaires soviétiques, tandis que de l’autre côté du rideau de fer, il en est une composante majeure.

La conception soviétique de la centrale nucléaire doit enfin être vue comme un système sociotechnique. De son élaboration à sa mise en œuvre opérationnelle, elle implique des méthodes de gestion très différentes de celles qui valent en Occident. Le facteur humain y est perçu comme une redondance dans le système de sûreté nucléaire permettant de pallier, grâce à l’existence de spécialistes à tous les échelons, les potentiels manquements de chacun d’entre eux.

Dans le même temps, la latitude d’intervention et de prise de décision laissée aux opérateurs des centrales est en réalité réduite par un carcan administratif rigide et contradictoire, conduisant à une relative impuissance de ces derniers.

À lire aussi :

Three Mile Island, Tchernobyl, Fukushima : le rôle des accidents dans la gouvernance nucléaire

Les corrections apportées aux centrales RBMK

Suite à la catastrophe de 1986, des améliorations palliatives sont apportées au design des réacteurs RBMK.

D’abord pour réduire les effets du coefficient de vide, qui reste toutefois toujours positif à l’issue de ces mesures.

-

Cela passe par l’addition entre 80 et 90 barres de contrôle inamovibles, qui remplacent une partie des crayons de combustible.

-

La consigne de laisser, au minimum, 26 à 30 barres de contrôle dans le cœur est relevée entre 43 et 48 barres.

-

Enfin le remplacement progressif du combustible est décidé pour augmenter sa qualité : il passe d’un enrichissement de 2 % à 2,4 % d’uranium.

Le système d’arrêt d’urgence est également modifié, avec un système d’arrêt rapide comprenant 24 nouvelles barres de contrôle et leur reconception.

RIA Novosti, CC BY-SA

De surcroît, de nouveaux systèmes d’alerte pour déclencher plus rapidement la procédure d’arrêt d’urgence sont installés. Le système de dépressurisation de la vapeur est aussi revu pour augmenter ses capacités de réduction de pression par condensation et évacuation.

Quarante ans après cette catastrophe, la Russie demeure le seul État à faire encore fonctionner des réacteurs RBMK, mais ce ne fut pas toujours le cas. L’Ukraine a interrompu la production électrique du dernier réacteur de Tchernobyl en l’an 2000, tandis que la Lituanie a fermé son dernier réacteur RBMK de la centrale d’Ignalina en 2009, dans le cadre de son adhésion à l’Union européenne.

À lire aussi :

Plus de trois décennies après Tchernobyl, la Russie joue crânement la carte nucléaire

![]()

Weidmann Antoine a reçu des financements de l’Université Bordeaux Montaigne.

– ref. 40 ans après la catastrophe nucléaire de Tchernobyl, l’insaisissable responsabilité – https://theconversation.com/40-ans-apres-la-catastrophe-nucleaire-de-tchernobyl-linsaisissable-responsabilite-280477