Source: The Conversation – France (in French) – By Grégory Miras, Professeur des Universités en didactique des langues, Université de Lorraine

Apprendre une nouvelle langue, c’est s’initier à de nouvelles sonorités et façons de prononcer. Mais cela suppose-t-il de gommer son accent ? La recherche montre qu’enseigner le français en tant que langue étrangère ne consiste pas forcément à imposer un modèle unique mais s’enrichit de la diversité de ses locuteurs. Explications.

Pourquoi entend-on si peu d’accents dans les médias français ? C’est une question qui a interrogé l’Institut national de l’audiovisuel (INA) à l’occasion des derniers Rendez-vous de l’histoire, organisés à Blois, en octobre 2025. Le mythe d’une langue « standard » s’oppose à la diversité des parlers français dits régionaux, de la francophonie et plus largement à la pratique du français dans le monde.

Ce constat invite à s’interroger sur la manière dont l’enseignement du français dans différents pays prend en compte la variété des accents des apprenants. Quelle place la prononciation tient-elle dans l’apprentissage du français comme langue étrangère ? Comment son approche évolue-t-elle à l’heure de l’IA ?

Exercices de prononciation et « surdité » phonologique

La didactique de la prononciation a particulièrement évolué au cours du temps au regard des technologies disponibles permettant à la phonétique, l’étude des sons, de se perfectionner. Enrica Galazzi, professeure à l’Université catholique du Sacré-Cœur (Italie), souligne que, même si la phonétique expérimentale allait devenir essentielle pour l’étude de la parole, sa naissance à la fin du XIXe siècle a été accueillie avec méfiance par les chercheurs français de l’époque. L’usage d’appareils scientifiques semblait alors mystérieux et suscitait la prudence, alors même que cette approche reposait sur un projet profondément humaniste.

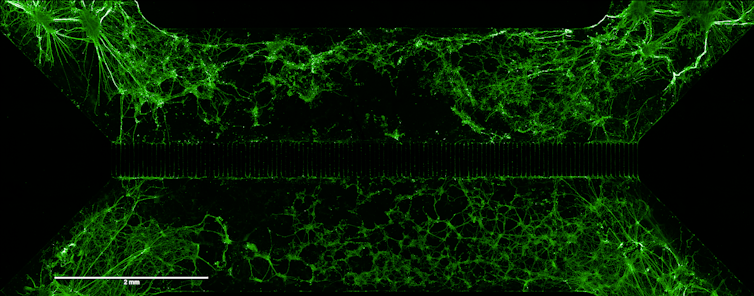

Très tôt, l’étude systématique des sons de la parole dans une vision comparée s’est focalisée sur les difficultés rencontrées par les locuteurs d’une langue qui apprennent le français, par exemple de l’espagnol au français. Ces travaux vont permettre de sensibiliser à ce que le chercheur Nikolaï Troubetzkoy a appelé le « filtre » ou la « surdité » phonologique. Cette dernière fait référence à la difficulté à percevoir et donc à produire de nouveaux sons d’une langue étrangère.

Cependant, cette approche a partiellement été remise en question par des modèles ultérieurs qui démontrent – de manière contre-intuitive – qu’il est parfois plus difficile d’acquérir des sons qui se rapprochent de ceux de sa langue première plutôt que ceux qui sont très différents. Toutefois, la plupart des manuels de prononciation en français langue étrangère continuent de se focaliser sur des exercices de répétition qui postulent que répéter permet d’apprendre.

En parallèle, d’autres méthodes ont mis l’accent sur des techniques spécifiques : association des voyelles et de couleurs, modulation des gestes du corps pour aider à l’articulation ou à l’intonation, répétition rapide de texte en même temps qu’un locuteur, etc.

De récentes méta-analyses ont montré que l’enseignement de la prononciation en langue étrangère est globalement efficace, surtout lorsqu’il est sur le temps long, accompagné de retours formatifs individualisés et mené par des enseignants avec un recours raisonné aux technologies numériques.

Toutefois, les études se concentrent encore majoritairement sur des sons isolés (des voyelles ou des consonnes), ne permettant pas de s’assurer d’une capacité à réinvestir ce travail dans des interactions en situation réelle. Produire des phonèmes ne garantit pas la capacité à être compris et à faire vivre le discours.

Être à l’écoute de la diversité des accents

En parallèle de ces techniques de correction, certains chercheurs en appellent à une médiation de la prononciation qui partirait de l’apprenant lui-même et des ses envies plutôt que d’imposer un seul modèle à atteindre, souvent celui imaginaire du « natif ».

Il s’agit de reconnaître que chaque individu qui apprend le français devient un locuteur légitime de cette langue et contribue donc à enrichir l’éventail des accents de la francophonie. Il peut donc déterminer son propre objectif en termes d’accents. Des auteurs comme Jacques Maurais défendent l’idée de la nécessité d’accepter toute la diversité en francophonie pour se décentrer d’une norme standardisée de la France hexagonale.

En effet, loin de compliquer la communication entre francophones (toute personne qui parle français), ces perspectives pourraient élargir les capacités du français à constituer un pont entre de nombreuses langues, et de nombreux individus.

À lire aussi :

« L’envers des mots » : Glottophobie

Dans sa thèse de doctorat, Aleksandra D. Savenkova a montré qu’il était possible d’intégrer des variations régionales du français (Sud-Ouest, Québec, Mauritanie, Guadeloupe, etc.) dans l’enseignement du français langue étrangère en Roumanie, même chez des débutants. Il est important de noter que des chercheurs comme Munro et Derwing ont démontré que tout ce qui contribue à la perception d’un accent dans une langue étrangère n’affecte pas forcément l’intelligibilité (capacité à transcrire ce qui est dit) ou la compréhensibilité (le sentiment d’effort pour comprendre).

Ils défendent l’idée de mieux éduquer tous les locuteurs à percevoir la diversité dans les langues plutôt que de se focaliser sur la seule correction de celui qui parle. Cela peut prendre, par exemple, la forme d’exercices d’écoute dans différentes langues présentant une variété d’accents. Le cerveau apprend ainsi à réduire le poids cognitif de la variation et facilite donc la compréhension.

Quelle place pour l’intelligence artificielle ?

La didactique de la prononciation est impactée par l’intelligence artificielle (IA) au même titre que les autres domaines. La plupart des plateformes d’apprentissage en ligne promettent de travailler sur votre prononciation via des modèles de reconnaissance de la parole offrant un retour formatif en temps réel.

Or ces modèles – majoritairement privés – ne permettent pas de savoir ce qui s’y cache en termes d’algorithme et de données d’entraînement. En effet, très souvent ce sont des modèles de voix à texte – une transcription de l’oral. Le retour formatif est fait à partir d’une comparaison de l’audio ainsi transcrit avec un modèle lui aussi écrit.

Par ailleurs, les IA génératives sont des technologies humaines qui produisent des biais liés à des erreurs reproduisant ainsi certaines discriminations, incluant celles sur l’accent.

Si les outils technologiques ont toujours été un support d’aide à l’individualisation pédagogique, ils ne peuvent constituer le centre de l’enseignement et l’apprentissage. C’est d’autant plus vrai pour la prononciation qui nécessite de co-construire l’intelligibilité et la compréhensibilité entre deux partenaires d’une même danse.

Actuellement, les recherches sur le langage tendent à mieux valoriser le fait que les locuteurs plurilingues mélangent les langues qu’ils maitrisent (le translanguaging) et qu’ils disposent d’un éventail de sons qu’ils mobilisent en fonction de leurs interlocuteurs et des contextes (la pluriphonie). Cela va donc dans le sens de faire entrer la diversité des accents dans les classes, les manuels et les applications de nos téléphones.

Penser la diversité des prononciations et des accents, c’est aussi réfléchir aux rapports de pouvoir entre les personnes. Mélanger les langues n’est pas neutre : le français, langue dominante marquée par une histoire coloniale, peut parfois affaiblir des langues minorisées ou menacées. Valoriser la diversité des sons des langues, c’est donc permettre à chacun d’être légitime dans le français qu’il apprend ou d’autres langues qu’il parle.

Cet article est publié en partenariat avec la Délégation générale à la langue française et aux langues de France du ministère de la Culture.

![]()

Grégory Miras ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d’une organisation qui pourrait tirer profit de cet article, et n’a déclaré aucune autre affiliation que son organisme de recherche.

– ref. Enseigner le français langue étrangère : faut-il « gommer » les accents ? – https://theconversation.com/enseigner-le-francais-langue-etrangere-faut-il-gommer-les-accents-267483