Source: The Conversation – in French – By Frédéric Lamantia, Docteur en géographie et maître de conférences, UCLy (Lyon Catholic University)

L’opéra, forme artistique et architecturale d’origine européenne, s’est diffusé au Moyen-Orient à partir du XIXe siècle, comme signe de modernité importée, avant de devenir un symbole culturel réinventé et un instrument de rayonnement international. Ce glissement d’un modèle occidental à une acclimatation locale s’opère selon les pays et les initiatives de leurs dirigeants alors que l’opéra, initialement perçu comme un art exogène, se mue progressivement en objet identitaire et diplomatique.

En Égypte, l’Opéra du Caire – plus ancienne implantation lyrique en Afrique et au Moyen-Orient – est inauguré en 1869 avec Rigoletto à l’occasion de l’ouverture du canal de Suez, tandis que, deux ans plus tard, Aïda est commandée à Verdi sur un sujet inspiré de l’Antiquité égyptienne.

Ces deux événements montrent à la fois le désir pour l’Égypte d’accéder à la modernité occidentale et l’influence que peut représenter la culture orientale pour les compositeurs européens. L’incendie de 1971 met un terme à cette aventure jusqu’à la construction dans un style islamique du Nouvel Opéra du Caire en 1988, grâce à un financement offert par le gouvernement japonais.

À partir des années 2010, des initiatives comme Balcony Opera permettent des actions « hors les murs » et mêlant répertoires arabes et occidentaux. Le rayonnement contemporain de chanteurs, comme Farrah El Dibany, alternant œuvres européennes et adaptations en arabe, illustre un va-et-vient entre traditions locales et programmation internationale standardisée.

Ce n’est pas le cas de l’Iran qui offre l’image d’une modernité lyrique interrompue. Depuis la fin du XIXe siècle, la formation d’une scène théâtrale moderne, nourrie des traductions de Molière mais aussi d’influences russes et caucasiennes, s’institutionnalise progressivement jusqu’à l’âge d’or des années 1960–1970 avec la Tehran Opera Company et l’inauguration du Vahdat Hall en 1967. La Révolution islamique de 1979 entraîne l’arrêt des activités lyriques. Depuis 2013, une renaissance partielle semble se dessiner sous la forme d’adaptations en persan d’œuvres importées, témoignant d’une résilience artistique.

Dans le cas d’Israël, l’histoire du lyrique se conjugue avec la construction culturelle nationale comme le montre la programmation, en 1923, de la Traviata, chantée en hébreu à Tel-Aviv, sous l’impulsion du chef d’orchestre et musicologue Mordecai Golinkin. La compagnie Israel Opera fonctionnera par la suite, de 1945 à 1984, avant que le New Israeli Opera s’installe en 1994 dans le Tel-Aviv Performing Arts Center.

La programmation mélange un répertoire international, mais aussi des œuvres abordant des thématiques juives et bibliques commandées à des compositeurs israéliens. Des productions comme The Passenger en 2012, dont l’histoire évoque l’Holocauste, inscrivent la mémoire et l’identité au cœur de l’activité lyrique locale associée à des politiques de médiation menée par Children Opera Hours, Magical Sounds.

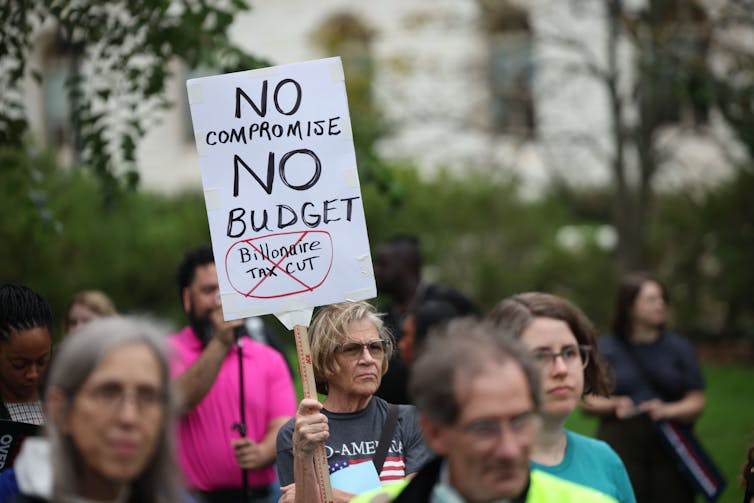

Des opéras symboles de pouvoir

La vague d’intérêt pour l’art lyrique qui a touché les pays du Golfe procède d’une autre logique, où l’opéra devient un dispositif de soft power, d’attractivité touristique et d’urbanisme. À Mascate (capitale d’Oman), l’Opéra Royal inauguré en 2011 couronne une stratégie initiée par le sultan Qabous, dès les années 1980, avec la création d’un orchestre symphonique national. Inséré dans un ensemble de 80 000 mètres carrés, incluant jardins, hall d’exposition, galerie d’exposition d’instruments de musique et espaces commerciaux, le site déploie une programmation éclectique qui associe répertoires occidentaux, créations arabes et musiques du monde en coproduction avec de grandes maisons européennes.

À Dubaï, l’ouverture en 2016 d’une salle modulable de 2 000 places, conçue par Janus Rostock, en forme de boutre (un voilier arabe) et implantée dans le quartier Downtown, associe une forte identité architecturale à une flexibilité d’usage. Elle joue aussi le rôle de locomotive pour l’hôtellerie, les commerces et le tourisme événementiel. Cette même logique opère au Qatar ou au Koweit. L’ambition de s’inscrire comme capitale culturelle s’y exprime à travers l’accueil de productions et d’orchestres internationaux.

De son côté, l’Arabie saoudite incarne une accélération singulière de la structuration de son territoire lyrique. Longtemps imperméable à l’opéra du fait de restrictions de nature religieuse (présence de femmes et musique occidentale non autorisées), le royaume s’y ouvre progressivement à partir des années 2010 avant de créer, en 2020, la Theater and Performing Arts Commission dans le cadre de Vision 2030. Son objectif est d’ouvrir le royaume à la modernité en renforçant notamment l’offre destinée aux touristes et aux hommes d’affaires.

En avril 2024, la création de Zarqa Al Yamama, premier grand opéra national de langue arabe, marque une étape symbolique avec le recours à un livret du poète et dramaturge saoudien Saleh Zamanan.

L’intrigue se déroule dans une Arabie préislamique et raconte l’histoire d’une femme extralucide pressentant une attaque d’ennemis, dont la tribu ignore les avertissements. Présentée au Centre culturel Roi Fahd, elle a montré la nécessité de bâtir des équipements spécifiquement conçues pour l’acoustique lyrique, la sonorisation de l’œuvre, riche d’influences musicales arabes, s’étant avérée indispensable dans cette salle de 2 700 places. Le territoire lyrique saoudien s’est progressivement enrichi d’un festival d’opéra, de programmes de collaboration internationale avec la programmation d’œuvres occidentales à Riyad et à Al-Ula tandis que des projets de nouveaux bâtiments sont envisagés à Riyad, à Djeddah ou à Diriyah.

Dans d’autres pays du golfe, la diplomatie culturelle et la patrimonialisation jouent un rôle structurant même sans maison d’opéra. Ainsi, la Jordanie a instauré le premier festival d’opéra du monde arabe à Amman, associant des artistes jordaniens à des partenaires italiens et projetant des créations à Pétra, croisant langues arabe, anglaise et nabatéenne.

Au Liban, le Festival international de Baalbek, fondé en 1956, a produit intégralement en 2025 et pour la première fois une œuvre (Carmen) alors que se profile un projet d’opéra national à Dbayeh, d’abord envisagé avec un soutien omanais puis porté par la Chine. Au-delà des infrastructures, deux figures emblématiques, Fairuz (âgée de 89 ans) et Sabah (disparue en 2014, divas de la musique arabe, façonnent l’imaginaire vocal libanais au-delà des frontières.

Des logiques territoriales différentes

On peut identifier plusieurs processus de territorialisation. Le premier, que l’on pourrait nommer « opéra-modernité » correspond à l’usage de la maison d’opéra comme signal d’entrée dans le modernisme avec un phénomène de patrimonialisation et d’adaptation, à l’image de l’Égypte du XIXe siècle. Le second que l’on pourrait qualifier d’« opéra-vitrine » se déploie surtout dans les pays du Golfe, associé généralement à des objectifs de soft power, de branding territorial, d’attractivité touristique et de requalification urbaine. Dépendant encore de compétences lyriques étrangères, l’enjeu à venir est d’arriver à concilier exposition à l’international et écosystème local et autonome. Le troisième processus reposerait davantage sur des stratégies de médiation et d’ancrage patrimonial.

À ces processus de territorialisation s’adossent des enjeux transversaux. L’intégration au lyrique de la langue comme de la musique arabes est centrale. Promouvoir un opéra en arabe nécessite d’enrichir la dramaturgie par des récits traditionnels, des références musicales – rythme de la poésie, maqâm – en dialogue avec les styles musicaux européens et leurs esthétiques. Les actions menées par Opera for Peace, par l’intermédiaire de ses master class, contribuent à structurer ce capital humain qui s’appuie sur des politiques de démocratisation, d’hybridation et de collaborations, mais aussi des financements pérennes. En outre, l’adossement à des sites patrimoniaux, très efficace pour unir spectacle, tourisme et récit identitaire, requiert des exigences techniques et administratives singulières.

En conclusion, l’art lyrique au Moyen-Orient est bien passé d’un modèle importé à un symbole culturel réinventé. L’opéra et son écosystème composé d’architectures emblématiques, de programmations premium et de festivals fonctionne, même s’il n’attire pas encore un public local conséquent. Si certains pays ont la capacité de financer seuls le déploiement de ce symbole de prestige, on note qu’après le Japon, la Chine investit désormais dans l’aide à la construction de maisons d’opéra dans cette région. Reste à savoir si la forme artistique pourra s’affranchir de son image de seule vitrine pour participer à la fabrique de récits, où l’arabe chanté, la musique traditionnelle et la mémoire des lieux contribueront à créer une modernité régionale à travers un processus de patrimonialisation propre à ces territoires.

![]()

Frédéric Lamantia ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d’une organisation qui pourrait tirer profit de cet article, et n’a déclaré aucune autre affiliation que son organisme de recherche.

– ref. L’opéra au Moyen-Orient, vitrine culturelle et outil de soft power – https://theconversation.com/lopera-au-moyen-orient-vitrine-culturelle-et-outil-de-soft-power-265314