Source: The Conversation – in French – By Alexandre Duparc, Cardiologue, Université de Toulouse

Wegovy, Mounjaro, Saxenda… Les analogues de l’hormone intestinale glucagon-like peptide-1 (GLP-1) ont beaucoup fait parler d’eux ces dernières années, en raison de leur efficacité en matière de perte de poids. Mais ces médicaments ne suffiront pas à vaincre l’obésité, dont la forte progression est due à de nombreux facteurs.

La lutte contre l’obésité est l’un des enjeux majeurs de la médecine du XXIe siècle. Cette maladie chronique, aux nombreuses complications physiques, psychologiques et sociales a vu sa prévalence mondiale doubler entre 1990 et 2022, date à laquelle elle touche, selon l’Organisation mondiale de la santé (OMS), plus d’un milliard de personnes (880 millions d’adultes et 160 millions d’enfants.

La France n’est pas épargnée. On considère qu’environ 8 millions de Françaises et de Français sont actuellement concernés par l’obésité. Sa prévalence est passée de 8,5 % en 1997 à 15 % en 2012, puis 17 % en 2020 et cette tendance va se poursuivre dans les années à venir.

Récemment, de nouveaux médicaments – les analogues de l’hormone intestinale glucagon-like peptide-1 (GLP-1) – ont intégré l’arsenal thérapeutique, suscitant de nouveaux espoirs. Cependant, ils ne permettront pas à eux seuls de vaincre l’obésité. Explications.

De nouvelles molécules efficaces

L’OMS définit le surpoids et l’obésité comme une accumulation anormale ou excessive de graisse, présentant un risque pour la santé. Une personne est considérée comme en surpoids si son indice de masse corporelle (IMC) est supérieur à 25, et comme obèse si celui-ci dépasse 30.

À lire aussi :

Pourquoi il est possible d’être obèse sans être en surpoids

Historiquement, la prise en charge thérapeutique de cette maladie s’est structurée autour d’une approche pluridisciplinaire et globale alliant conseils d’hygiène de vie (activité physique, alimentation), suivi psychologique, prévention et traitement des complications. Pour les cas les plus sévères, le recours à la chirurgie bariatrique peut être envisagé.

Les thérapeutiques médicamenteuses sont longtemps restées en retrait. On se souvient de l’échec du dexfenfluramine (nom commercial Isomeride, autorisé en France de 1985 à 1997), puis du benfluorex (nom commercial Mediator, autorisé de 1976 à 2009). Tous deux ont été retirés du marché en raison de leurs effets secondaires aux conséquences dramatiques, notamment cardiaques (dégradation des valves cardiaques) et pulmonaires (hypertension artérielle pulmonaire). Le Mediator reste associé à l’un des plus retentissants scandales sanitaires des dernières décennies.

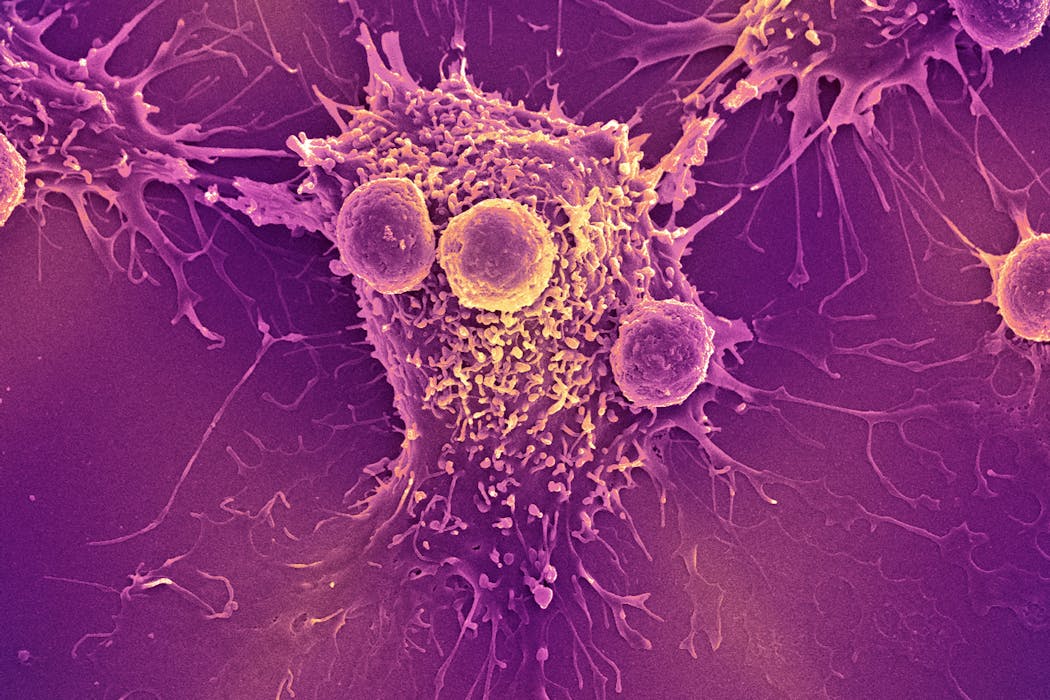

Depuis peu, une nouvelle classe de molécules est à la disposition du corps médical pour lutter contre l’obésité : les analogues du peptide glucagon-like 1 (GLP-1). Cette petite hormone permet d’augmenter la production d’insuline, et donc de mieux absorber le glucose. Elle a un effet central bénéfique sur la satiété et retarde la vidange gastrique (le vidage de l’estomac). Parmi ces nouveaux médicaments figurent le liraglutide (commercialisé sous les noms Saxenda pour l’obésité ou Victoza pour le diabète), le sémaglutide (noms commerciaux Wegovy pour l’obésité ou Ozempic pour le diabète) et le tirzépatide (Mounjaro).

Prescrites sous forme d’injections hebdomadaires, ces molécules étaient déjà indiquées en routine dans la prise en charge du diabète de type 2. Plusieurs essais cliniques de grande envergure chez les sujets obèses ou en surpoids mais indemnes de diabète ont démontré l’efficacité de ces médicaments en complément d’une prise en charge alliant diététique et activité physique. Le bénéfice semble dépasser la seule perte de poids, puisqu’on constate également une amélioration de certains paramètres cardiovasculaires et métaboliques.

L’autorisation de mise sur le marché permet actuellement de les prescrire en complément d’un régime hypocalorique et d’une augmentation de l’activité physique, chez l’adulte ayant un indice de masse corporelle supérieur à 30 kg/m2 ou supérieur à 27 en cas de co-morbidité liée au poids. Toutefois, l’Assurance maladie ne les rembourse pas.

Ces traitements, qui apparaissent comme simples, efficaces et moins invasifs que la chirurgie, ont soulevé un enthousiasme légitime. Il est cependant illusoire d’imaginer que le combat contre l’obésité puisse se réduire à l’injection hebdomadaire d’un médicament. En effet, les causes de l’obésité et du surpoids sont multifactorielles, et dépassent la problématique du seul déséquilibre entre apports et dépenses caloriques.

Obésité, surpoids : des multiples causes

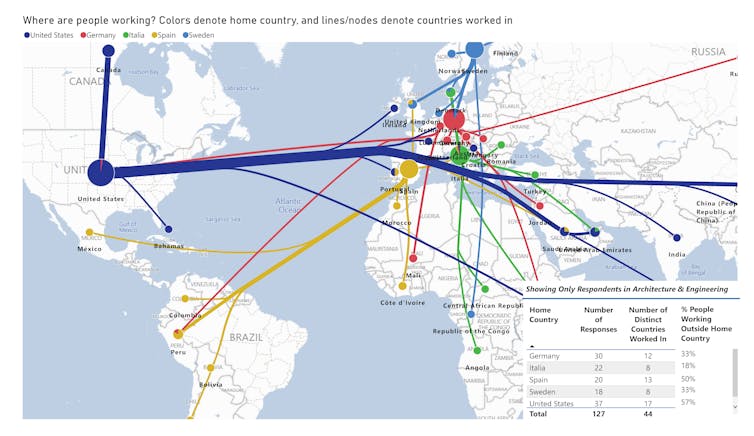

Les travaux de recherche ont révélé que les risques de surpoids et d’obésité dépendent de plusieurs déterminants : des facteurs génétiques (et épigénétiques), endocriniens (autrement dit, hormonaux), médicamenteux (certains traitements augmentent le risque), psychologiques, sociologiques ou encore environnementaux.

Concernant ce dernier point, on sait aujourd’hui que de nombreuses substances omniprésentes dans l’environnement sont classées comme obésogènes. Elles peuvent perturber notre métabolisme hormonal (perturbateurs endocriniens), modifier notre microbiote intestinal, ou agir à l’échelle génétique et épigénétique.

Dans ce contexte, le concept d’exposome, défini comme « l’ensemble des expositions environnementales au cours de la vie, y compris les facteurs liés au mode de vie, dès la période prénatale », prend tout son sens.

À lire aussi :

Épigénétique, inactivation du chromosome X et santé des femmes : conversation avec Edith Heard

Dans certains cas, les effets des déterminants impliqués dans l’obésité peuvent rester latents pendant de nombreuses années, et les conséquences ne s’exprimer que tardivement, voire aux générations suivantes. Le diéthylstilbestrol (plus connu sous son nom commercial Distilbène) est un exemple emblématique de ces effets métaboliques transgénérationnels, non seulement en matière de surpoids et d’obésité, mais également en ce qui concerne le risque de cancers.

C’est pour rendre compte de ces phénomènes causaux que le concept de developmental origins of health and disease (DOHaD) – origines développementales de la santé et des maladies – a été forgé.

Une fois exposée la complexité de l’obésité, il apparaît donc évident que les cibles sur lesquelles agissent les analogues du GLP-1 (production d’insuline, satiété) sont loin d’être les seules impliquées dans la maladie.

Par ailleurs, on constate que les sources d’obésité ont, pour la plupart, des conséquences négatives sur la santé qui vont au-delà de la seule prise de poids. Ainsi, la consommation excessive de sucres raffinés, d’aliments ultratransformés, de viande rouge, de charcuterie, le manque de fibres, l’exposition à des toxiques, ou encore la sédentarité sont autant de facteurs de risques de santé dégradée.

Des molécules qui ne font pas de miracles

Les analogues du GLP-1 ne peuvent pas « guérir » l’obésité. Ce n’est d’ailleurs pas ce que prétendent les auteurs des études qui en ont testé l’efficacité.

Selon les résultats de l’étude STEP3, la perte de poids sous sémaglutide est de 15 % après 68 semaines de traitement (contre 5 % dans le groupe placebo). Si l’on considère le profil « type » des patients inclus dans cette étude, soit des individus ayant un IMC moyen à 37 (ce qui correspond à un poids de 100 kg pour une taille de 1m65), une perte de poids de 15 % les mènera à un IMC à 31. Ils passeront alors d’une obésité sévère à une obésité modérée. Si le gain en termes de santé est considérable, ces sujets présenteront encore un surrisque médical significatif.

Il convient également de se questionner sur la tolérance du traitement, ainsi que sur son observance chez des patients dont les ordonnances peuvent être très longues du fait des polypathologies. Par ailleurs, le maintien de l’efficacité au long cours reste à déterminer, a fortiori si l’ensemble des facteurs causaux n’est pas éradiqué.

Se posent aussi les problématiques de la prise de poids à l’arrêt du traitement, ainsi que de la sarcopénie, c’est-à-dire la perte musculaire, qualitative ou quantitative. En effet, une perte de poids ne se résume jamais seulement à une perte de masse graisseuse, mais s’accompagne également d’une perte de masse maigre, notamment musculaire. Ce phénomène pourrait être prévenu ou compensé grâce à l’exercice physique.

L’importance de la prévention

À ce jour, les analogues du GLP-1 sont envisagés comme traitement de l’obésité une fois que celle-ci est installée. Il s’agit donc d’une approche curative. Les articles scientifiques partent du principe que les mesures de préventions, dites « hygiénodiététiques » sont insuffisantes alors que les modalités d’élaboration de ces mesures ne sont que rarement questionnées, pas plus que la possibilité de s’attaquer aux nombreux facteurs qui entravent leur mise en pratique.

Les conseils adressés au grand public sont en effet essentiellement diffusés sous forme de messages ou d’injonctions à modifier les comportements individuels. Ils font donc implicitement reposer la responsabilité sur chacun et chacune, et sont, en ce sens, potentiellement culpabilisants. Parallèlement, ils passent le plus souvent sous silence les autres facteurs causaux qui structurent notre exposition globale.

Parmi les facteurs qui entravent la prévention, citons :

-

la facilité d’accès à des aliments favorisant l’obésité (sucrés, salés, ultratransformés), bon marché, vantés par la publicité, peu régulés et peu taxés alors que leur caractère néfaste est avéré ;

-

l’obstruction à la généralisation d’outils pourtant largement validés tels que le Nutri-Score, illustrant le fait que la question sanitaire passe généralement après les intérêts économiques, tant à l’échelle française qu’européenne ;

-

le contexte environnemental défavorable, exposant les individus à de multiples polluants. Nombre d’entre eux favorisent l’obésité, notamment via des mécanismes hormonaux ;

-

les manquements des politiques d’aménagement du territoire qui devraient promouvoir les mobilités actives et l’accès aux infrastructures d’activités physiques et sportives sur l’ensemble du territoire (urbain, semi-urbain et rural) et lutter ainsi contre la sédentarité et le manque d’activité physique ;

-

l’impact des déterminants socio-économiques ou psychologiques qui rendent difficilement applicables les comportements vertueux en termes d’alimentation et d’activité physique.

Rappelons le poids des inégalités (socio-économiques, de genre, ethno-raciales, territoriales…) dans la santé en général et particulièrement dans les questions touchant à l’obésité . En France, 17 % des individus dont le niveau de vie est inférieur au premier quart de la distribution sont obèses contre 10 % pour ceux dont le niveau de vie appartient au quartile de niveau de vie supérieur.

À lire aussi :

Obésité et « manque de volonté » : les préjugés négatifs ont la vie dure

L’augmentation de la pauvreté, de la précarité et le creusement des inégalités sociales sont à ce titre inquiétants, car ils ne peuvent que dégrader les conditions de santé des populations les plus défavorisées.

Prévenir coûterait moins cher que guérir

Terminons sur un point impossible à ne pas considérer : celui du coût du traitement par analogues du GLP-1, évalué à environ 300 euros par mois et par patient.

Sans remboursement, ce traitement ne sera accessible qu’aux plus aisés. S’il est pris en charge par l’Assurance maladie, le coût potentiel apparaît comme vertigineux. L’OMS prévoit en effet que d’ici 2030, près de 30 % de la population française pourrait être concernée par l’obésité.

Conclusion, la communauté des soignants, associée à celle des patients, ne peut compter exagérément sur cette classe de médicaments. Pour lutter contre l’obésité, il faut continuer à valoriser une prise en charge pluridisciplinaire, alliant des savoirs académiques, issus de différentes disciplines scientifiques, avec des savoirs souvent qualifiés d’« expérientiels » : ceux des patients, des professionnels de l’éducation et de la prévention en santé, des décideurs en matière de politiques de santé, etc.

Cette approche est certes moins spectaculaire et moins facilement médiatisable que les annonces tonitruantes qui accompagnent les découvertes de thérapies innovantes, mais elle est indispensable. La prévention ne s’oppose pas au traitement curatif : elle le précède, et l’accompagne.

On ne peut espérer diminuer significativement et durablement la prévalence de l’obésité qu’en ciblant l’ensemble des facteurs qui la sous-tendent, individuels, sociaux et environnementaux. Cela implique l’élaboration et la mise en œuvre de politiques de santé publique larges, ambitieuses et respectueuses de la démocratie sanitaire.

Il faut avoir conscience que cela ira vraisemblablement à l’encontre d’intérêts économiques de court terme. Mais la santé publique en vaut sans aucun doute la chandelle.

![]()

Alexandre Duparc n’a pas de conflit d’intérêt financier à déclarer. Il est membre de L’Atecopol et de Scientifiques en Rébellion

Philippe Terral a reçu des financements de l’ANR, l’INCa, l’IRESP, la Fondation de France.

Tania Pacheff est membre de l’association “no plastic in my food” (ex-Cantine sans plastique France)

Olivier Lairez ne travaille pas, ne conseille pas, ne possède pas de parts, ne reçoit pas de fonds d’une organisation qui pourrait tirer profit de cet article, et n’a déclaré aucune autre affiliation que son organisme de recherche.

– ref. Obésité : pourquoi les nouveaux médicaments ne sont pas des remèdes miracles – https://theconversation.com/obesite-pourquoi-les-nouveaux-medicaments-ne-sont-pas-des-remedes-miracles-259846