Source: The Conversation – USA (2) – By Jennifer Duyne Barenstein, Senior Lecturer of Social Anthropology, Swiss Federal Institute of Technology Zurich

More than 1.8 billion people lack access to adequate and affordable housing. Yet too few countries have taken meaningful steps to ensure dignified housing for their most vulnerable citizens.

We research how cooperative housing can serve as one solution to the affordable housing crisis. There are a variety of cooperative housing models. But they generally involve residents collectively owning and managing their apartment complexes, sharing responsibilities, costs and decision-making through a democratic process.

Some countries have embraced cooperatives. In Zurich, Switzerland, almost one-fifth of the city’s total housing stock is cooperative housing.

Other countries, such as El Salvador and Colombia, have struggled to integrate housing cooperatives into their countries’ preexisting housing policies. In fact, although Latin America has a long-standing tradition of community-driven and mutual aid housing, housing cooperatives haven’t taken root in many places, largely due to weak political and institutional backing.

Uruguay is an exception.

With a population of just 3.4 million, the small Latin American nation has a robust network of housing cooperatives, which give access to permanent, affordable housing to citizens at a range of income levels.

An experiment becomes law

Housing cooperatives in Uruguay emerged in the 1960s during a time of deep economic turmoil.

The first few pilot projects delivered outstanding results. Financed through a mix of government funds, loans from the Inter-American Development Bank and member contributions, they were more cost-effective, faster to build and higher in quality than conventional housing.

These early successes played a key role in the passage of Uruguay’s National Housing Law in 1968. This law formally recognized housing cooperatives and introduced a legal framework that supported different models. The most common models to emerge roughly translate to “savings cooperatives” and “mutual aid cooperatives.”

In the savings model, members pool their savings to contribute around 15% of the capital investment. This gives them access to a government-subsidized mortgage to finance the construction. The cooperative then determines how repayment responsibilities are distributed among its members. Typically, members purchase “social shares” in the cooperative, equivalent to the cost of the assigned housing unit. If a member decides to leave the cooperative, their social shares are reimbursed. These shares are also inheritable, allowing them to be passed on to heirs.

In contrast, the mutual aid model enables households without savings to participate by contributing 21 hours per week toward construction efforts. Tasks are assigned to individuals according to their abilities. They can range from manual labor to administrative tasks, such as the ordering of construction materials.

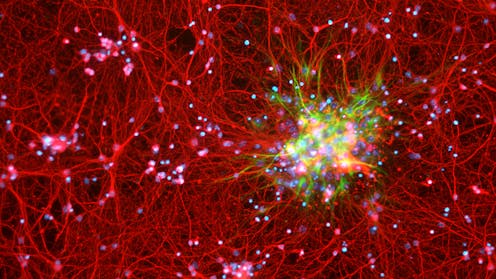

Federación Uruguaya de Cooperativas de Vivienda por Ayuda Mutua, CC BY

Despite their differences, both models share a fundamental principle: The land and housing units are held collectively and are permanently removed from the private market.

Typically, once cooperatives are established, each household must contribute a monthly fee that covers the repayment of the state’s loan and maintenance costs. In exchange, members have an unlimited and inheritable contract of “use and enjoyment” of a quality apartment. If a member decides to leave, they are partially reimbursed for the contributions they’ve made over time, typically with a 10% deduction that the cooperative keeps.

This ensures that cooperative housing provides long-term security and remains affordable, especially for those at the lowest rungs of the income ladder.

State support and public buy-in

Today, Uruguay has 2,197 housing cooperatives, supplying homes to approximately 5% of the country’s households. Around half of them are located in the nation’s capital, Montevideo, where 1,008 cooperatives operate. Cooperatives can have as few as 12 homes or as many as 700 apartments.

This growth has been possible thanks to state support, federations of cooperatives and nonprofit groups.

The state recognized that the success of housing cooperatives depended on sustained public support. The National Housing Law defined the rights and responsibilities of cooperatives. It also outlined the state’s obligations: overseeing operations, setting criteria for financial assistance and providing access to land.

Housing cooperative federations have also played a key role. FECOVI, the federation of the savings cooperatives, represents over 100 cooperatives, serving roughly 5,000 households. FUCVAM, the federation of mutual aid cooperatives, is much larger and more politically active, representing over 35,000 households across 730 cooperatives.

Beyond organizing and advocating for the right to housing – and human rights more broadly – FUCVAM offers its member cooperatives a wide range of support services, including training to strengthen cooperative management, legal counseling and conflict mediation.

Finally, a vital pillar of this model are the Technical Assistance Institutes, which were also recognized by the National Housing Law. These are independent, nonprofit organizations that advise cooperatives.

Their role is crucial: The construction of large-scale housing projects is complicated. The vast majority of citizens have no prior experience in construction or project management. The success of Uruguay’s cooperative model would be unthinkable without their support.

From the outskirts to the city center

Uruguay’s housing cooperatives have not only expanded, but have also evolved in response to changing needs and challenges.

In their early years, most cooperatives built low-density housing on the outskirts of cities. This approach was largely influenced by the ideals of the Garden City movement, a planning philosophy of the late 19th century that prioritized low-density housing and a balance between development and green spaces. In Uruguay, there was also a cultural preference for single-family homes. And land was more expensive in city centers.

These early cooperatives, however, contributed to urban sprawl, which has a number of drawbacks. Infrastructure has to be built out. It’s harder to reach jobs and schools. There’s more traffic. And single-family homes aren’t an efficient use of land.

Meanwhile, in the 1970s Montevideo’s historic city center started experiencing abandonment and decay. During this period, the country’s shifting socioeconomic landscape created a set of new challenges. More people relied on irregular incomes from informal work, while more single women became heads of households.

In response, housing cooperatives have shown a remarkable ability to adapt.

For women, by women

As urban sprawl pushed development outward, Montevideo’s historic center, Ciudad Vieja, was hemorrhaging residents. Its historic buildings were falling apart.

Seeking to revitalize the area without displacing its remaining low-income residents, the city saw housing cooperatives as a solution.

This spurred the creation of 13 mutual aid cooperatives in Ciudad Vieja, which now account for approximately 6% of all housing units in the area.

One of the pioneers of this effort was Mujeres Jefas de Familia, which translates to Women Heads of Household. Known by the acronym MUJEFA, it was founded in 1995 by low-income, single mothers. MUJEFA introduced a new approach to cooperative housing: homes designed, built and governed with the unique needs of women in mind.

Architect Charna Furman spearheaded the initiative. She wanted to overcome the structural inequalities that prevent women from finding secure housing: financial dependence on men, being primary caregivers, and the absence of housing policies that account for single women’s limited access to economic resources.

Remaining in Ciudad Vieja was important to members of MUJEFA. Its central location allowed them to be close to their jobs, their kids’ schools, health clinics and a close-knit community of friends and family.

However, the project faced major hurdles. The crumbling structure the group acquired in 1991 – an abandoned, heritage-listed building – needed to be transformed into 12 safe, functional apartments.

The cooperative model had to adapt. Municipal authorities temporarily relaxed certain regulations to allow older buildings to be rehabbed as cooperatives. There was also the challenge of organizing vulnerable people – often long-time residents at risk of eviction, who were employed as domestic workers or street vendors – into groups that could actively participate in the renovation process. And they had to be taught how to retrofit an older building.

Today, 12 women with their children live in the MUJEFA cooperative. It’s a compelling example of how cooperative housing can go beyond simply putting a roof over families’ heads. Instead, it can be a vehicle for social transformation. Women traditionally excluded from urban planning were able to design and construct their own homes, creating a secure future for themselves and their children.

Building up, not out

COVIVEMA 5, completed in 2015, was the first high-rise, mutual aid cooperative in a central Montevideo neighborhood. Home to around 300 residents, it’s made up of 55 units distributed across two buildings.

Members participated in the building process with guidance from the Centro Cooperativista Uruguayo, one of the oldest and most respected Technical Assistance Institutes. Architects had to adapt their designs to make it easier for regular people with little experience in construction to complete a high-rise building. Cooperative members received specialized training in vertical construction and safety protocols. While members contributed to the construction, skilled labor would be brought in when necessary.

Members of the cooperative also designed and built Plaza Luisa Cuesta, a public square that created open space in an otherwise dense neighborhood for residents to gather and socialize.

Housing cooperatives are neither public nor private. They might be thought of as an efficient and effective “third way” to provide housing, one that gives residents a stake in their homes and provides long-term security. But their success depends upon institutional, technical and financial support.

This article is part of a series centered on envisioning ways to deal with the housing crisis.

![]()

Jennifer Duyne Barenstein receives funding from The Swiss National Science Foundation. She is affiliated with the Centre for Research on Architecture, Society and the Built Environment, Department of Architecture, ETH Zurich

Daniela Sanjinés receives funding from the Swiss National Science Foundation. She is affiliated with the Centre for Research on Architecture, Society and the Built Environment, Department of Architecture, ETH Zurich.

– ref. What the world can learn from Uruguay as the global housing crisis deepens – https://theconversation.com/what-the-world-can-learn-from-uruguay-as-the-global-housing-crisis-deepens-258342